![图片[1]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260314021539219-1773425739-b4c831fe6bbc3d5c9a8cfe57feb418db.jpeg)

新智元报道

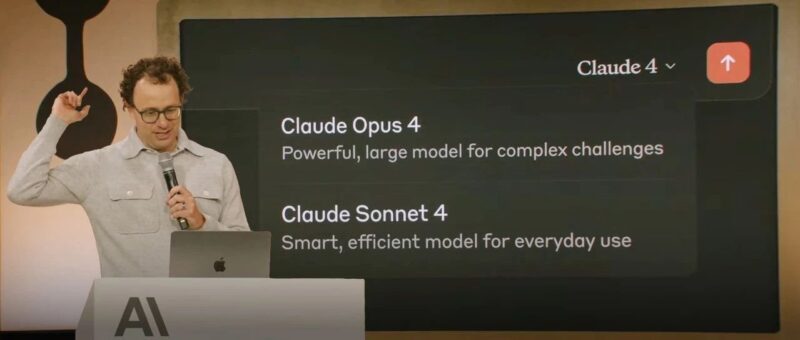

【新智元导读】2026年3月9日,Anthropic在加州和华盛顿特区联邦法院起诉国防部。Anthropic自塑「AI底线英雄」形象,大打舆论战;五角大楼反击:你们才是伪君子!这场博弈关乎未来战争的灵魂归属。

忍无可忍,Anthropic起诉五角大楼!

被美国政府列为「供应链风险」后,据多家媒体报道,Anthropic本周起诉五角大楼。

![图片[2]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260314021542707-1773425742-3d30d9be92da92a3e964272cac30b302.png)

![图片[3]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/05/1748005937-e247941b79065a0391afc9648900dec5.png)

目前的情况是:上周,五角大楼正式将Anthropic列为「供应链风险」对象。

这意味着相关公司凡是在与国防部直接相关的业务场景中,都必须停止使用Claude,断了Anthropic的一条财路。

与此同时,特朗普也曾在他的个人社交平台Truth Social上发文,要求美国政府停止使用Anthropic的技术,美国部分政府机构也已开始停用Claude。

Anthropic对此忍无可忍,提出诉讼。

第一起诉讼已提交至美国加州北区联邦地区法院。

在起诉书中,Anthropic称,国防部此举本质上是在报复,惩罚他们公开表达其AI政策立场,尤其是其一贯主张:应当防止AI被用于大规模美国本土监控和自主武器。

Anthropic认为:

政府可以不同意我们的观点,也可以拒绝合作。

但不能因为我们的言论,就把公司贴上「安全风险」标签。

Anthropic还在华盛顿特区巡回上诉法院提起了第二起、篇幅更短的诉讼。公司解释称,由于政府援引的另一部法律只能在该法院提出异议,因此必须同步在两个司法辖区寻求救济。

五角大楼方面则坚持认为,这场争议的核心不是言论自由,而是作战控制权。

国防部官员称,问题始终在于军方是否能够依法使用技术,而不是让供应商介入指挥链条,进而给作战人员带来风险。

不过,双方并非完全没有和解空间。

上周,美国国防部副部长Emil Michael接受采访时表示,他愿意保持开放态度:

我的责任是对战争部负责;如果有办法确保我们拿到最好的技术,我并没有什么面子包袱。

故事要从Emil Michael去年走马上任说起。

![图片[4]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/05/1748005937-e247941b79065a0391afc9648900dec5.png)

去年8月,Emil Michael接管了五角大楼的AI项目。

他仔细研究了Anthropic以及其他AI公司的合同条款。

结果越看越震惊。

其中最关键的一条:禁止使用Anthropic的AI来规划动能打击(kinetic strikes)——也就是通过导弹、炸弹等动能武器实施的军事攻击。

![图片[5]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/themes/zibll/img/thumbnail-lg.svg)

而这种行动,本质上正是战争的核心内容之一。

五角大楼正式将Anthropic列为「供应链风险(supply-chain risk)」公司。

这意味着:国防部可以把它列入类似黑名单的供应商名单,因为它被认为可能威胁国家安全或军事行动。

不过,Michael也强调:这项限制只针对为战争部提供服务的项目。

例如,AWS仍然可以为Anthropic提供非军事用途的云服务。

即便如此,这个决定仍然可能对Anthropic造成巨大冲击。

不少业内人士认为,美国政府是在惩罚这家公司,甚至试图「摧毁」它。

原因是双方的观念差异。

![图片[4]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/05/1748005937-e247941b79065a0391afc9648900dec5.png)

在进入大众失业前,五角大楼与Anthropic不断拉锯。

谈判中,Michael花了大量时间向Anthropic解释战争部最基本的运作方式,以及逐一推演各种战争场景。

他举过一个例子。

设想这样一个场景:

夜晚,美军某军事基地,众人都在睡觉。

突然,一群无人机蜂群向基地袭来——数量成百上千,人类根本来不及防御。

如果部署了AI防御系统,它可以用激光武器快速击落这些无人机。

对于这个场景,Anthropic团队最终同意在服务条款中增加一个例外。

于是,谈判变成了一场想象力竞赛——

Michael必须尽可能提前设想未来所有可能发生的战争场景,并逐一申请条款豁免。

他又举了另一个例子。

如果有一波高超音速导弹向我们袭来,人只有90秒反应时间,而且存在一种安全方式可以拦截,但人类根本来不及操作怎么办?

Anthropic的回答是:「嗯……那也许可以算例外。但每次发生这种情况,你都要打电话来申请。」

Michael当场无语:「战争可不是这么运作的。」

根据媒体Semafor的报道,Anthropic彻底否认了这种说法。

![图片[7]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260314021552795-1773425752-f82fc035ddabe2d77e6a017578eb38cc.png)

但Michael表示:「当时在会议室里的20个人都可以证明,这件事确实发生过。」

随着讨论不断推进,谈判也越来越疲惫。

不管提出什么场景,Anthropic立场坚定、毫不妥协:

只要超出其「服务条款」,最终解释权必须在Anthropic手里,或者只能「视情况」批准例外。

最后,Michael只能说:「各位,我不可能为一个三百万人规模的部门预先写出所有例外,更不可能预测未来。」

![图片[8]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260314021555600-1773425755-58872f9cc211f8686a24d9ad61f73cc6.png)

他的诉求其实很简单:「在合法范围内,允许战争部自由使用AI技术。」

真正让双方关系紧张的「导火索」,出现在抓捕马杜罗行动之后。

![图片[9]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260314021559598-1773425759-9fdafaa5ab5491aef49c05f9dd6ef94b.png)

![图片[10]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/05/1748005946-e42712f61a4e6b0adba95f6bacb450c6.png)

Michael表示,那次突袭行动中使用了Palantir的系统,而该系统集成了Anthropic的AI模型Claude。

这次行动伴随着真实的动能打击。

行动结束一段时间后,媒体披露:Anthropic一名高管主动联系了Palantir的相关人员,想详细了解 Claude在这次行动中究竟是如何被使用的。

![图片[11]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260314021603589-1773425763-194c7d1a38b90d6b9fb7e3bdd80a9077.png)

Michael认为,这个举动本身就很敏感。

「他们当时是在试图打听机密信息,这在军方体系里是绝对不允许的。」

据Michael描述,Anthropic甚至暗示:如果他们不同意某次军事行动的使用方式,理论上可以直接‘拔掉电源’。

正是因为这一点,一名Palantir的高管随后向五角大楼报告了这次交流,因为他担心这会影响未来军事行动的完整性和可靠性。

Michael回忆了Anthropic的大概意思:

如果我们不喜欢这次突袭中AI的使用方式,那可能就违反了服务条款。

那我们随时可以停止提供软件,甚至设置新的限制,让某些行动无法执行。

他强调,这种情况极其危险——

「这真的很吓人,因为那意味着你把真实的人命置于风险之中。军事行动不是开玩笑的,对吧?」

不过,据报道,Anthropic对这一说法予以否认,发言人称,Anthropic从未向任何行业合作伙伴表达过类似担忧,双方的沟通「仅限于严格的技术层面的常规讨论」。

![图片[12]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260314021606851-1773425766-7922acb4fdda65927917295be08725d1.png)

![图片[4]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/05/1748005937-e247941b79065a0391afc9648900dec5.png)

近期,Anthropic树起了坚持底线的英雄形象,大造舆论。

这样做一举多得:既能吸引更多AI人才,也能博得消费者同情。

所有媒体报道都集中在两个问题上:

自主武器

大规模监控

Michael认为,这两个话题就是危言耸听,根本不是真相。

他怀疑这都是Anthropic的舆论战,

例如,路透社去年一篇报道就提到: 消息人士称Anthropic担心其工具可能被用于监视美国公民,或在缺乏人类监督的情况下用于武器攻击目标选择。

![图片[14]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260314021608266-1773425768-419c1f8dbf28d5405f155b18d002a5a5.png)

Anthropic的解释是:

其技术目前还不足以可靠地支持完全自主武器

AI在国内监控领域的潜力,法律还没有明确规范

但Michael认为,这全是「烟雾弹」。

例如,在监控问题上,Amodei的担忧是:

政府购买的公开数据可能被AI自动转录、分析、交叉验证,从而推断出公民的态度和忠诚度。

Michael确认为Anthropic是贼喊抓贼、掩耳盗铃:

Anthropic可以买数据库、抓取互联网海量数据,但五角大楼不行。

他觉得这简直荒唐。

而且,搞大规模国内监控,跟五角大楼有什么关系?搞审查,侵犯隐私,突然发明一些离谱的搜查令去,只为了突袭民宅?

至于自主武器,在过去与五角大楼的合作中,Anthropic本身就认同美国的新一代导弹防御系统「金穹计划」。所以,他认为Anthropic所作所为不过是在洗白自己!

![图片[4]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/05/1748005937-e247941b79065a0391afc9648900dec5.png)

Michael解释说,未来军方会越来越依赖AI。

但如果AI公司在模型中嵌入自己的价值观或政策立场,那就会成为严重的供应链风险。他说:

我真的担心,他们的模型会带着自己的「宪法」、灵魂和政策偏好。

他甚至提出了一个极端假设:

如果Anthropic在模型中嵌入某种意识形态偏好,比如反对某些军事行动,那么他们交付给战争部的产品可能会被故意做得不可靠。

例如,使用Claude设计导弹时,模型可能故意让某些关键部件设计失败。

他说:「假设是一枚激光制导导弹,但他们让激光系统无法工作,因为他们觉得目标不该被打击。」

Michael的结论很简单:

我不能接受一把枪在关键时刻失灵,只因为Anthropic不喜欢枪。

我们是军队,我们当然会用枪。

在Michael看来,军方最看重的是可靠性。

因为一旦战争爆发,士兵必须相信合作伙伴、供应商、软件、硬件都能正常运作。

![图片[4]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/05/1748005937-e247941b79065a0391afc9648900dec5.png)

这场官司背后,真正值得警惕的,不是谁在打舆论战,而是一个越来越清晰却可怕的现实:美国已经把AI推上军事前线。

从情报分析到导弹防御,从无人机集群到作战系统,AI正一步步嵌入美国战争机器。

今天争的是合同和权限,明天争的,可能就是谁把生杀大权交给算法。

更可怕的是,「天网」不再只是科幻警告,正在变成现实世界里的战争底层系统——更快、更冷、更难控制。

当机器开始学习战争,人类离失控就不远了。

技术不该成为屠杀的加速器。

AI不该通向下一场战争。

悬崖勒马,停止AI武器化的狂飙,让科技回归和平!

别让人类亲手创造的最高智慧,最终沦为埋葬我们自己的「核武器」。

![图片[17]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/10/c79a0da0a19ad66c831baa7a391a0e27.jpeg)

![图片[18]-忍无可忍!Anthropic怒告五角大楼-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/01/20260101203539201-1767270939-a915c63cfe6f7cc68cc454f351b00750.jpeg)

<原文链接:https://mp.weixin.qq.com/s/0Cf5sgkRmd5ve9zWhpiWnw

暂无评论内容