世界模型从“预训练时代”开始走向“强化学习精细化调优时代”。

3月10日,腾讯混元3D团队开源业界首个面向世界模型的强化学习后训练框架WorldCompass,这是此前发布的混元世界模型1.5 官方强化学习扩展模块,能够让世界模型的交互更加准确,体验更好。

![图片[1]-混元世界模型再进化:开源首个面向世界模型的强化学习后训练框架WorldCompass-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260311004600648-1773161160-641c9989f4fde42ee6504664c66c2a70.jpeg)

混元世界模型1.5于2025年12月首次发布,是业界首个可体验的实时世界模型。

现有的生成式世界模型(如WorldPlay等)虽然展现了惊人的潜力,但主要依赖于预训练阶段的像素级监督。这种“依样画瓢”的学习方式,往往导致模型在面对复杂的组合动作指令时“听不懂”,或者在长距离漫游中出现画质崩坏和路径漂移。

为了解决这一难题,腾讯混元团队推出了WorldCompass。这是一个专为长时序、交互式世界模型设计的强化学习(RL)后训练框架。如果说世界模型是引擎,那么WorldCompass就是精准的“指南针”,通过引入强化学习机制,直接“引导”模型如何更准确地遵循用户指令探索世界,并保持长时序的视觉一致性。

实验表明,WorldCompass能显著提升 SOTA 开源世界模型(WorldPlay)的交互准确率和视觉保真度,特别是在复杂的组合动作场景下,交互准确率提升了近35%。

核心痛点:为什么世界模型需要RL后训练?

当前的主流世界模型通常采用自回归生成范式。然而,仅靠预训练(Pre-training)存在明显局限:

1. 缺乏直接反馈:现在世界模型的训练目标是预测下一帧内容,而不是“向左转”这个动作本身。

2. 复杂指令失效:对于“一边前进一边左转”这样的复合动作,由于组合形式多样,视频数据很难完全覆盖,因此仅靠像素模仿很难精准执行。

WorldCompass的提出,正是为了通过强化学习(RL),引入显式的动作跟随奖励和视觉质量奖励,对预训练好的世界模型进行“对齐”和“微调”。

WorldCompass 技术亮点

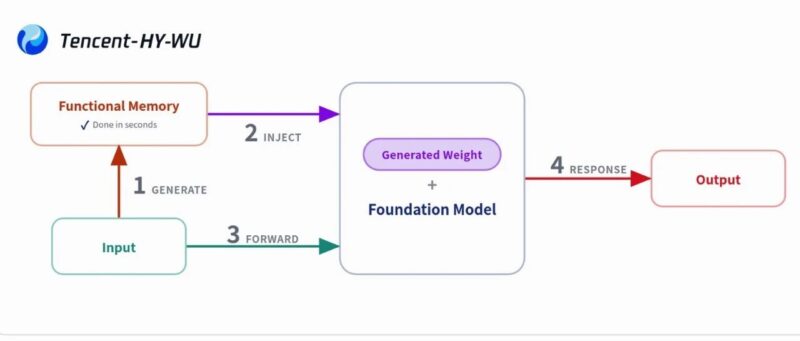

WorldCompass 针对自回归世界生成的特性,对传统 RL 框架进行了全方位的重构,提出了三大核心创新:

![图片[2]-混元世界模型再进化:开源首个面向世界模型的强化学习后训练框架WorldCompass-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260311004604254-1773161164-351b9364e4105fda9c4dee5931dfb14d.png)

1、切片级采样:针对自回归世界生成的细粒度采样策略

传统的语言模型RL通常是对整句进行采样评分,但对于长序列视觉生成来说,这种方式效率极低且反馈稀疏。WorldCompass 提出了 Clip-level Rollout(切片级采样) 策略:在生成第 n 个视频片段时,复用前 n-1 个片段的历史信息,仅对当前片段进行多次并行采样(Rollout)。这个改进极大地降低了计算复杂度,同时能够针对每一个微小的片段提供细粒度的奖励信号,在自回归视频生成过程中精确定位出动作不符和画质下降的片段。

2、3D奖励函数:拒绝“奖励刷分”

在RL训练中,模型容易出现“奖励刷分(Reward Hacking)”现象。例如:为了满足动作指令而生成乱码,或者为了画质好而无视动作指令。WorldCompass 设计了两种互补的奖励函数来相互制约:

● 交互跟随评分(Interaction Following Score):利用先进的3D基础模型(WorldMirror),从生成的视频中反解出相机轨迹(平移和旋转),并与用户的输入指令进行比对。

● 视觉质量评分(Visual Quality Score):采用画质评分模型对生成视频的美学质量和图文一致性进行评分。两者互为正则项,迫使模型在保证画质的前提下精准执行动作,避免了顾此失彼。

3、高效 RL 优化算法:让训练更稳、更快

针对模型参数量大、训练昂贵的问题,WorldCompass 采用了一种基于负样本感知的微调策略(Negative-aware Fine-tuning),并结合了多项优化:

● Best-of-N 采样:从采样的样本中挑选最好的和最差的进行对比学习。

● 课程学习(Curriculum Learning):随着训练进行,逐渐增加视频生成的长度(从短时序到长时序),让模型循序渐进地掌握长距离漫游能力。

评测结果:性能全面跃升

定量指标评测

团队在最新的开源SOTA模型 WorldPlay上进行了全面验证。结果显示,经过WorldCompass的后训练,模型能力实现了质的飞跃。

![图片[3]-混元世界模型再进化:开源首个面向世界模型的强化学习后训练框架WorldCompass-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260311004606963-1773161166-50645f53ef93a7ee00a84e81b325fbce.png)

在最为困难的复合动作(Combined Action)场景下(例如同时进行移动和旋转):基座模型对于复杂组合式动作序列执行的准确率仅为 20% 左右。使用 WorldCompass 训练后,准确率提升至 55% 左右,提升幅度超过 35%。对于基础动作,准确率也提升了约10%。

同时,在斯坦福大学世界模型Benchmark WorldScore上,WorldCompass取得了更好的评分:

![图片[4]-混元世界模型再进化:开源首个面向世界模型的强化学习后训练框架WorldCompass-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260311004608803-1773161168-18fcc39938cecd5eecad57d71aa2b022.png)

可视化效果测试

实测效果可以看出,使用 WorldCompass后,模型对于向左、向右、向前、向后等不同视角的指令,执行准确率明显提升。

WorldCompass 的发布,标志着世界模型从“预训练时代”迈向了“RL精细化调优时代”。作为首个针对长时序、交互式世界模型的RL框架,WorldCompass 成功解决了动作控制不精准的痛点。它不仅证明了强化学习在世界模型领域的巨大潜力,也为未来构建更加智能、可控的“生成式世界模拟器”提供了全新的技术路径。

该技术已在混元WorldPlay模型上得到验证,相关代码和模型细节已开源。访问以下地址了解更多:

主页:https://3d-models.hunyuan.tencent.com/world/

技术报告:https://arxiv.org/abs/2602.09022

代码(github):https://github.com/Tencent-Hunyuan/HY-WorldPlay

<原文链接:https://mp.weixin.qq.com/s/yaMJG6oxw-FjWfKFK574mA

暂无评论内容