上个月,全球计算机存储领域的顶级学术会议——第23届USENIX文件与存储技术会议(USENIX Conference on File and Storage Technologies,简称FAST),在美国加利福尼亚州圣克拉拉举行。

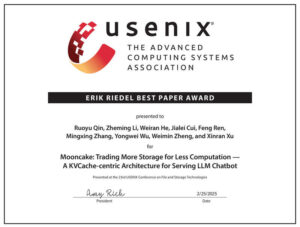

本届大会上,来自中国的人工智能(AI)初创公司月之暗面(Moonshot AI)和清华大学团队合作发表论文并在其中提出一个名为Mooncake的系统,因而获得埃里克·里德尔最佳论文奖(Erik Riedel Best Paper Award)。

香港《南华早报》3月14日报道认为,Mooncake这一款大语言模型系统的效率比之前的基准提高了五倍,从而帮助降低了对计算资源的需求。在美国长期就中国获取先进AI芯片进行围堵打压的背景下,这一成果还有助于对抗美国芯片禁令、减少对英伟达等企业出产的图形处理单元(GPU)的依赖。

而在本月,无问芯穹(Infinigence AI)和上海交通大学、清华大学共同提出的视频生成大模型推理IP工作——FlightVGM,也在国际顶级会议上获奖。他们首次在可重构逻辑集成电路(FPGA)上实现了视频生成模型(VGMs)的高效推理,在美国半导体公司AMD广泛可用的V80 FPGA芯片上,该系统在性能上提升了30%,能效比英伟达旗舰产品RTX 3090 GPU高出4.5倍。

《南华早报》称,中国AI科研团队用工业芯片取代英伟达高端GPU而获全球大奖,这预示着全球优化AI硬件的竞赛也出现了重大转变。

![图片[1]-中国团队连获国际大奖-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/0665869d7ctype_jpeg_size_865_132_end.jpg)

埃里克·里德尔最佳论文奖 清华大学网站新闻图

据报道,这篇获奖论文由清华大学计算机系教师章明星、武永卫、郑纬民团队和月之暗面公司合作发表,名为“以键值缓存为中心的以存换算大语言模型推理架构”(Mooncake: Trading More Storage for Less Computation-A KVCache-centric Architecture for Serving LLM Chatbot)。论文的第一作者为计算机系博士生秦若愚,导师为助理教授章明星。

根据清华大学方面的介绍,该论文提出的系统Mooncake,是月之暗面推出的大语言模型服务Kimi的底层推理服务平台。Mooncake采用了一种以键值缓存(KVCache)为中心的分离架构,不仅将预填充和解码集群分离,还高效利用了推理集群中未充分利用的CPU、DRAM、SSD和NIC资源,构建了一个独立的KVCache缓存池。其核心创新在于以KVCache为中心的全局缓存和调度器,旨在严格延迟相关服务级别目标(SLOs)下最大化吞吐量。

实验结果显示,Mooncake在处理长上下文输入的场景中表现出色。在使用真实数据进行的测试中,与基线方法相比,Mooncake在符合SLOs的情况下,将有效请求处理能力提升了59%至498%。目前,Mooncake已在数千个节点上运行,每日处理超过1000亿个token。在实际部署中,Mooncake的创新架构使Kimi在NVIDIA A800和H800集群上分别比以前的系统多处理115%和107%的请求。

《南华早报》指出,一段时间以来,美国政府已对向中国出口先进AI芯片实施了一系列限制措施,包括对英伟达高端芯片的多项禁令。

![图片[2]-中国团队连获国际大奖-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/9531420f92type_jpeg_size_700_150_end.jpg)

英伟达的AI芯片在全球范围内广泛部署。 《华尔街日报》

早在2022年10月,美国政府就已实施了一系列AI芯片出口限制措施,英伟达由于无法向中国市场提供A100和H100这两款AI处理器,专门为中国市场特供符合美方规定的A800和H800芯片,以绕开美国政府的管制。

2023年10月,美国商务部又发布了一系列新的芯片出口限制,扩大了对高级AI芯片的定义,并对运往40多个国家的芯片产品提出额外的许可要求,以避免转售给中国。这一新的限制措施出台,意味着A800和H800芯片也被列入禁售名单。

美方想方设法围堵打压,就是意图限制中国在AI领域的计算能力,进而压制AI模型的训练和开发。然而,这些限制反而促使中方研究人员和企业寻求通过软件优化和创新数据结构来挖掘现有芯片潜力的方法。

据报道,清华大学MADSys实验室已在软件源代码托管服务平台GitHub上启动了Mooncake项目,旨在加速该技术的采用和传播。与此同时,该项目已被包括阿里巴巴和蚂蚁集团在内的多家公司内部采用,并已融入开源社区。

今年1月,中国AI初创公司深度求索(DeepSeek)发布的开源大模型DeepSeek-R1,使用由英伟达H800 GPU驱动的数据中心进行训练,仅用两个月就完成了训练,成本为550万美元,仅为OpenAI等美国公司所花费金额的一小部分,却实现了足以匹敌美国顶尖AI模型的效果,“低成本且高效能”的特点不仅震撼业界,同时也引发多国关注,尤其是美国。

彭博社此前介绍称,在DeepSeek火爆出圈以及中国AI行业蓬勃发展之际,一些互联网公司多年来也一直在深耕AI领域,而此次与清华大学团队合作的月之暗面也是其中之一。

![图片[3]-中国团队连获国际大奖-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/4f9f4a51abtype_jpeg_size_960_178_end.jpg)

中国AI初创企业深度求索(DeepSeek) 《纽约时报》

月之暗面公司由清华大学助理教授杨植麟创立,他此前曾在脸书母公司Meta和谷歌从事AI项目工作。月之暗面最新发布的产品利用强化学习来加速和扩展训练过程,该产品与DeepSeek的R1推理模型在同一天宣布,工作原理相似。推理模型采用思维链的方法来寻找和完善对查询的回答。Kimi k1.5旨在提供更简洁的回答,并支持最多200万字符的中文语境,这些语境可以包含从过往对话到用户意图和情境的所有内容。

FAST是计算机存储领域的顶级学术会议,已创立20余年,在存储领域具有重要影响力,被中国计算机学会(CCF)认定为存储系统领域的A类国际学术会议。

值得注意的是,除了此次在FAST上获奖之外,中方团队近期也在其他顶级学术界会议上频频获奖。

3月3日,在刚刚落幕的国际可重构计算领域顶级会议“FPGA 2025”上,会议的最佳论文奖颁发给了无问芯穹和上海交通大学、清华大学共同提出的视频生成大模型推理IP工作——FlightVGM。据了解,这是FPGA会议首次将该奖项授予完全由中国大陆科研团队主导的研究工作,同时也是亚洲国家团队首次获此殊荣。

据介绍,这项工作首次在可重构逻辑集成电路上实现了视频生成模型的高效推理,也是该团队继去年在FPGA上加速大语言模型FlightLLM(FPGA’24)后的最新系列工作。与英伟达3090 GPU相比,FlightVGM在AMD V80 FPGA上实现了1.30倍的性能提升与4.49倍的能效提升(峰值算力差距超过21倍)。

对此,《南华早报》在3月12日的报道中认为,在向美国科技巨头英伟达的AI硬件领域主导地位发起勇敢挑战中,中国研究人员在一款现成的工业芯片上训练出一个尖端视频生成模型,其在速度和效率上都超越了高端GPU。而这也预示着,全球优化AI硬件的竞赛出现了重大转变。

暂无评论内容