【本文要点】

GPT-4o的多模态图像生成功能上线后,迅速受到欢迎,应用案例不断涌现,如电商商品图、UI设计、表情包等。该功能使得设计师和电商团队能够简化工作流程,提高生产效率。然而,它对普通设计师造成了冲击,可能导致部分岗位消失,但专业设计工作流仍然具有不可替代性,因为对数据隐私、设计精度的需求不会消失。同时,GPT-4o与ComfyUI等开源工具各自有利弊,前者在普及性与效率上表现突出,后者则在专业级应用中不可或缺。OpenAI也面临GPU算力不足的问题,需限速图像生成以维护系统稳定。总体来看,GPT-4o的创新推动了设计行业的变革,但专业需求仍然保障了传统工作流的继续存在。

【正文】

在我的群里,已经能看到越来越多的,进入到实际生产环节的例子。

比如@银海的直接做商品图的翻译和合成,这是原来的算法,很难做的效果,但是现在,有手就行。

![图片[1]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/deeab57325type_png_size_960_54_end.png)

非常复杂的电商流程,一张原始图,换产品换脸换衣服。

![图片[2]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/53020b1f91type_png_size_805_100_end.png)

比如@歸藏的直接把UI图放样机里面的例子,如果做过UI或者产品设计的朋友肯定都知道,以前我们在做展示,或者做汇报的时候,经常做样机做的挺痛苦的。

![图片[3]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/8a44f7f892type_png_size_960_138_end.png)

比如给他头像,画的两套表情包,是可以直接上架到微信表情商店的那种。

![图片[4]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/7a6dc8e9d6type_png_size_960_259_end.png)

![图片[5]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/f61eb6e170type_png_size_960_200_end.png)

来自一个顶级消费品公司的电商设计团队负责人@黄花鱼,用GPT-4o来直接做之前非常流行的3D品牌海报。

![图片[6]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/41a6791c96type_png_size_960_98_end.png)

比如我一个很喜欢的小红书AI博主@Rico有三猫,用GPT-4o给她做小红书封面。

![图片[7]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/1f29b20b41type_png_size_960_51_end.png)

群友@默月佥在用GPT-4o出蜜蜂的解剖科普图。

![图片[8]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/d9f1ea9871type_png_size_839_107_end.png)

一个很专业的公众号AI博主@阿真lrene,不仅用GPT-4o生成复杂的漫画,还能抠图,一键直出透明通道的PNG图。

![图片[9]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/2e747021cdtype_png_size_790_80_end.png)

干死各种抠图软件的不是更牛逼的抠图软件,而是大模型。。。

还有朋友@不知名网友虎子哥,用GPT-4o给他自己家的房子装修。。。

![图片[10]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/d0b5f50d8ftype_png_size_960_64_end.png)

还有一些我确实不知道源头的但是被传播的蛮广的例子(如有作者,欢迎评论区认领)。

给几个家具做一个展示图,这个场景在电商领域无敌。

![图片[11]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/da604ee2cbtype_jpeg_size_832_94_end.jpg)

之前我写可灵的AI模特的时候,很多人问,能不能让模特戴首饰?现在,可以了。

![图片[12]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/af9291bba2type_png_size_593_88_end.png)

还用它,直接P图,消除人物。

![图片[13]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/72bc2f1658type_png_size_759_102_end.png)

![图片[14]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/c841dbcc5btype_png_size_903_120_end.png)

甚至,还可以模仿字体做字体设计。

![图片[15]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/df6abe62c0type_png_size_846_85_end.png)

在GPT-4o的冲击下,N多的设计师和创业者,都有点emo了。

比如就有大佬在X上感叹道:

![图片[16]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/080c65f1c1type_png_size_960_166_end.png)

朋友圈里还看到了一张图,是glif的老板,在X上发的。

![图片[17]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/1693e7df9ctype_png_size_1000_95_end.png)

纪念ComfyUI,纪念一切的AI图像工作流。

OpenAI的一次更新,又屠杀了一堆公司。

又一次深刻的阐明了那句《三体》中的经典台词:

我消灭你,与你无关。

GPT-4o的冲击当然是有,但是,他的上限在哪?能做到什么地步?真的能彻底替代ComfyUI的AI图像工作流吗?

我想弄清楚这个答案。

首先我觉得我还是要跟大家非常简单的用一两句话解释一下ComfyUI,让大家知道这玩意是个啥,我们才好继续往下聊。

ComfyUI是一个非常专业的工作流工具,不局限于AI绘图,AI视频啥的也都可以往里面接。他的界面大概是这样的,很像电路板。

![图片[18]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/8e610048e6type_png_size_960_202_end.png)

这个就是在Liblib上搭的ComfyUI工作流。

它是以节点方式,把各个工具、各个模型给串起来,形成一整套的工作流,比如一张图进去,经过各种节点和插件,输出一个完全风格不同的AI视频,这都是OK的。

坦率的讲,我不是ComfyUI的专家的,做过的工作流也不多,我觉得在这个领域,我并没有那么强的发言权,所以。

我去请教了一下我的1个好朋友,AI绘图大神@炼丹师忠忠。

我想听听,他的看法。

首先是,GPT-4o对电商设计的冲击到底有多大?

我跟忠忠聊了很久。

最后得到的结论,跟我自己在设计行业里感受到的水温差不多。

对于普通水平的电商设计师,肯定是有打击的,他们原有的技能水平也就只能产出跟gpt4o差不多的图,相对来说意义不大了。

上游的运营专员可以自己操作工具来生产一样质量的图。跟被冲击的插画师类似,可能会变为帮忙修补gpt4o产出的图的bug,还有叠加原图部分细节上去加强细节还原(类似于高低频修复流程)。

生产成本降低后,需求量会变大,原本用不起各种华丽背景图包装的商家,现在也用的起了。

从效果上极简操作就能生图的工具有美图设计室等一堆工具,GPT4o只是在某些效果方面更进一步而已,对于专业级的实际商业生产的影响可能没有那么大。

而从视觉设计角度,对现有的整个开源生态,反而是利好作用。

忠忠举了自己设计的公司IP的例子。

现在,可以一句话把IP的3D模型,直出到品牌海报上,不需要走以前的3D建模+渲染了,大大节省了时间。

![图片[19]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/1c9ebd56dftype_jpeg_size_793_112_end.jpg)

![图片[20]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/691accb0cdtype_png_size_960_133_end.png)

同时,更有趣的一点是,GPT-4o可以根据一张IP草图,来生成这个IP的各角度视图。

![图片[21]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/0e55551e29type_png_size_960_106_end.png)

而这些图,会进一步推动flux等开源模型的微调版本的效果。

你可能会问,都有GPT-4o了,为什么还要去微调flux,在ComfyUI搭工作流用呢?这不是脱裤子放屁多此一举呢?

其实有两个原因。

数据隐私性和精准性。

数据隐私很好解释,就是GPT-4o是一个闭源的模型,后面最多最多也就是开放一个API,让大家接到ComfyUI里面去用,但是,就OpenAI这个尿性,我们给过去的东西,大概率就成他后续的训练素材了。

举个例子,《流浪地球3》2027年上映,要是现在美术组把核心概念图或者设定图直接灌给GPT-4o做一些处理,到时候,《流浪地球3》电影还没上映,设定图你可以直接在GPT-5o里面让它画出来,这特么就炸了。。。

所以,数据隐私性至关重要,在真正的生产环境里,特别是一些大厂里,必须只能用本地的ComfyUI搭,真正的输出,必须是本地环境,用开源的模型。

所以,这个时候,我们就可以用一些不敏感的信息,扔给GPT-4o,来辅助生成数据集,反过来微调自己的flux模型,这个点,真的很有用。

精准性其实也很简单,我们回过头来看忠忠用GPT-4o输出的自己家IP的海报。

![图片[22]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/7e6c4a3204type_png_size_960_133_end.png)

先不说其他的细节了,这几处,你是能发现一些明显的BUG的。

这其实在生产环境里,这种BUG是品牌方觉得不可能接受的,就想你给一个手机产品做广告,你把人手机弄变形了,你跟人说不行AI出得就是这样的,你看对面会不会把你挂在电风扇上转着打。

而这个时候,用Flux专门微调的Lora,是可以完美的解决这种精准性和一致性的问题的。

这其实就是普通设计场景和专业设计场景的区别。

GPT-4o当然可以替代大部分的普通工作流,会让ComfyUI里一大批的工作流失去价值,但是这就不代表,ComfyUI失去价值了。

很简单的一点是,在专业的设计工作里,纯对话式的简单界面满足不了复杂专业的需求的。

就像你问一个专业设计师,为什么设计是用PS做设计,而不用美图秀秀来做设计,对方只会把你当傻子。

在真正的专业的AI设计工作里,可控性,很多时候非常的重要。

需要精确的规定重绘区域,需要精确的调节风格效果,出图尺寸比例等,所以在专业生产中需要精确调节的细节,不能指望OpenAI全做成功能。

![图片[23]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/ad2f0626cctype_png_size_960_174_end.png)

还有前后处理流程,比如说前置的裁剪,抠图,语义识别,后置的比如对图片的放大,贴回原图细节(高低频修复),再接入其他工作流继续处理等。

自动化一键完成的效率要比多轮对话高很多。

包括在一些精准度要求高的产品和场景上,GPT-4o目前还达不到专业级的水准。

看个例子。

比如我们要把问界M9这款车,换到另一个场景里。车这种产品,跟笔、戒指、香水等等要求的精细度,完全不一样。

![图片[24]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/47a4b345b2type_png_size_960_131_end.png)

这是GPT-4o出的图。

![图片[25]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/1ea7177156type_png_size_1000_150_end.png)

而如果我们用大佬的牛逼工作流呢?

![图片[26]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/5fdb70f122type_png_size_960_202_end.png)

生成出来的效果在整体比例和质感上,是更好的。

![图片[27]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/f64a5fc79ctype_png_size_960_192_end.png)

这里我要给自己叠个甲,我并不是在这里鼓吹,GPT-4o不行,ComfyUI的效果可以吊打GPT-4o。

如果是这样的话,我也不会连更两篇,来给大家看一看,GPT-4o,有多酷,有多强。

我想说的是,GPT-4o,跟当年的SD、Midjorney、Runway、可灵等等AI工具是一样的。

会无差别替代所有这个行业里面的初级执行职位。

屠杀所有曾经在工程层面对大模型进行的一些优化。

然后,一点一点侵蚀更上层的建筑。

它更像是一层层汹涌上涨的潮水,将整个AI图像领域原有的边界打得支离破碎。

都说做AI产品,要看到大模型的边界,在边界之外的安全地带做。

但是现在,你根本不知道边界在何方。

那些看似高耸的技术壁垒与工作流程,如果只是基于简单组装或者初级执行的逻辑,正在被GPT-4o以近乎暴力的方式消解。

绝大多数机械式的制作工作,一旦被强大的多模态理解与生成替代,就会像那些轰然倒塌的围墙一样,被历史的风尘轻易覆盖。

有没有一种第一次工业革命时候,机器代替手工劳动的即视感?

![图片[28]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/03d871a29dtype_jpeg_size_608_180_end.jpg)

历史总是在不断的重复。

可一如上文所言,这绝不代表ComfyUI之流就会被完全淘汰。

在工业级、专业级的深度工作流里,人们对数据安全、设计精度、可控度的需求不可能凭空消失。

那种图像与视频的多次处理、分层输出、版本管理、脚本化批量运行、自动化节点衔接,只要是大型企业或核心团队,都会很在意。

GPT-4o会在C端和中小B端市场里摧枯拉朽,取代了大量低端或者重复性工作。

而ComfyUI、Flux、ControlNet等开源生态则在更专业的领域继续进化,利用它们精细、可控、可离线部署的特性,为高端客户或机密项目提供服务。

这气势就像云端办公与本地办公的关系一样,前者无限便捷,后者安全可控。

也如同家用轿车与顶级跑车的分别,各自目标用户并不冲突。

GPT-4o也一定会不断进化,去扩大自己的边界蚕食更多的场景。

开源生态也会有各种可以复刻效果的模型、产品出来,从而进行私有化。

没什么能够阻止浪潮向前。

要么成为浪潮的追随者,要么成为浪潮的推手。

这二者,都肯定比做一块沉在海底的礁石,要精彩得多。

你说是吗。

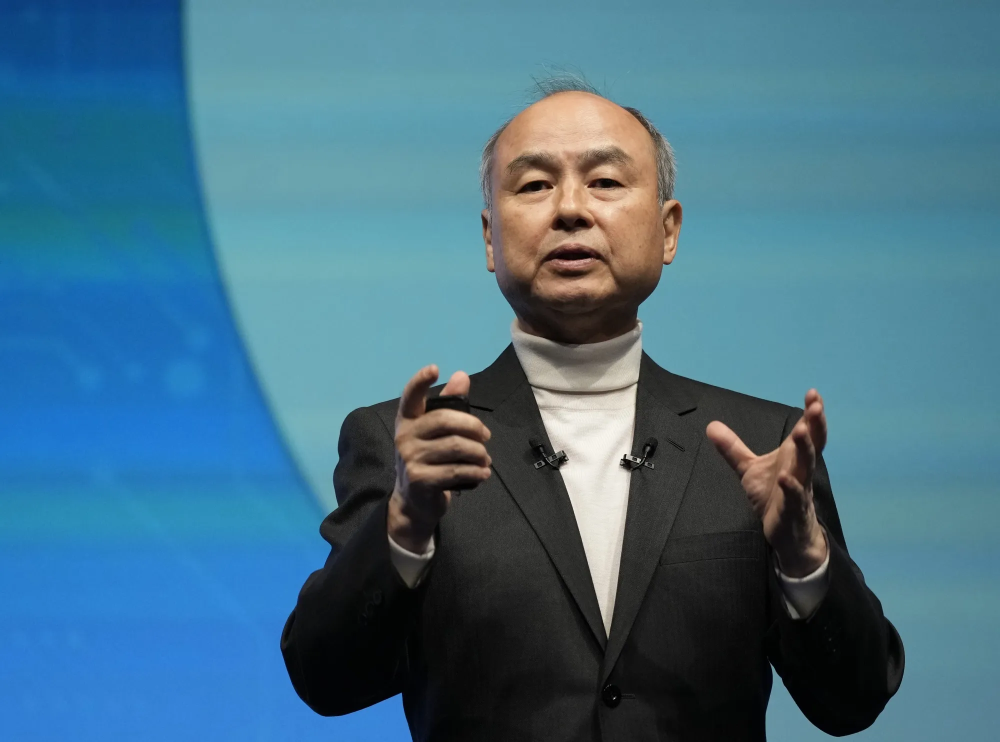

多模态又考验算力了 ChatGPT文生图功能火爆 奥尔特曼:GPU冒烟了

随着OpenAI的图像生成功能完成重大升级,新的问题出现了。

OpenAI创始人Sam Altman表示:ChatGPT的文生图应用需求过高,我们的GPU“冒烟了”(melting,原为融化之意),在努力提高效率的同时,将暂时对ChatGPT生成图片的功能引入一些速率限制。

![图片[29]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/7e5f041158type_png_size_475_159_end.png)

![图片[30]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/67b3485b8ftype_png_size_472_236_end.png)

这意味着,OpenAI将对ChatGPT的图像生成功能实施临时限速,降低单位时间内的请求处理量,缓解GPU过载压力,并优先保障文本生成、对话等核心功能的稳定性,或许将暂时放缓图像生成的技术优化节奏。

此前3月26日,OpenAI推出基于GPT-4o模型的图像生成功能——Images in ChatGPT,用户可在ChatGPT及Sora平台直接通过自然语言指令生成、编辑图像,支持多轮迭代优化。这标志着ChatGPT正式将文本、图像、代码等多模态能力深度整合,实现从单一语言模型向全模态智能体的跨越。

该功能上线后,以“动动嘴就能P图”的便利迅速火爆,互联网平台上涌入大量由个人照片、知名梗图转变而来的“吉卜力”卡通风格图片。连Altman也感叹起该功能带来的泼天流量:“自己过去十年埋头苦干做AI,试图帮助实现超级智能来治愈癌症之类的事情。前7.5年几乎无人问津,接下来的两年半,做什么都会引来所有人的厌恶。然后某天醒来收到几百条消息,人们告诉你被画成了吉卜力风格的美少年。”

![图片[31]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/4b3503c609type_png_size_735_219_end.png)

![图片[32]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/61f2ef5e09type_png_size_960_150_end.png)

生成自Images in ChatGPT

![图片[33]-GPT-4o 多模态生图,让整个设计圈开始都 emo 了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2025/03/43d1cd624ctype_png_size_960_150_end.png)

生成自Images in ChatGPT

与此同时,由于图像生成功能的受欢迎程度远超预期,OpenAI原本计划本周向所有用户推送这项功能,但现在“被迫”推迟了向免费用户开放新功能的时间。

与作为扩散模型运行的DALL•E根本区别是,GPT-4o图像生成是原生嵌入在ChatGPT中的自回归模型。OpenAI根据在线图像和文本的联合分发来训练模型,使得模型可以学习图像与语言的关系,使其生成有用、一致且具备上下文感知的图像。

GPU就像一群超级快的“画师”,能同时处理大量计算任务,生成图片(如DALL•E、Stable Diffusion)需要AI逐像素计算,每一步都要处理海量数据。而让AI生成更精确、更高清的图像依赖于GPU的大规模并行计算。OpenAI提到,因为这个模型会创建更详细的图片,所以图像需要更长的渲染时间,通常会达到一分钟。

如此一来,文生图功能的用户越多,需要的GPU算力成倍增长。

解决方式主要有两种,更强的GPU或更高效的AI模型,前者走“力大砖飞”路线,后者寄希望于算法的优化,即通过改进AI算法让同样的GPU能处理更多任务(比如用更小的模型或压缩技术)。

作为AI领域的头部玩家,OpenAI背后的GPU储备自然是业内顶尖水准。根据技术咨询公司Omdia的分析,微软作为OpenAI的主要投资者,在2024年购买了约48.5万块英伟达的Hopper芯片,是其主要竞争对手Meta的两倍,这使其成为英伟达GPU的最大买家。OpenAI的大模型正是用微软的Azure云基础设施进行训练。

可以说,OpenAI因新功能面临的问题,折射了AI多模态技术发展中的资源与需求平衡难题,一方面,AI应用对GPU等算力资源的需求依然庞大,另一方面,行业继续呼唤技术迭代,以求高效利用现有资源

【新闻来源】

暂无评论内容