Meta 发了篇新论文。

我看第一眼就觉得,这不就是我天天遇到的问题吗。

你让 AI 智能体帮你挑衣服,它记住了你爱穿黑色。

三个月后你口味变了,开始喜欢彩色。

它还在给你推黑色。

你纠正它一次,它下次还犯。

问题不在它不够聪明,在它没有"记忆"。

核心发现

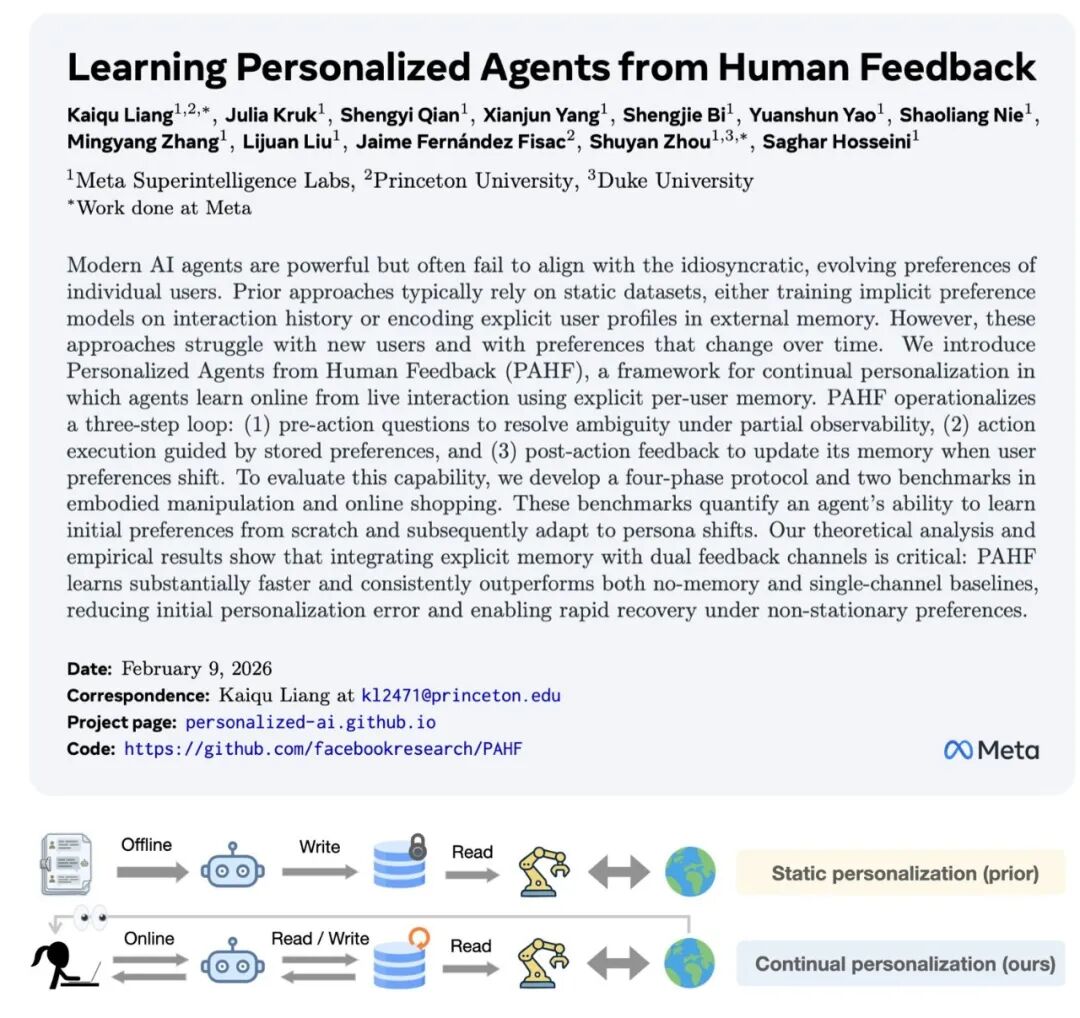

AI 智能体很强大,但不会随着你的偏好变化而"长大" 它们依赖静态数据集,新用户来了抓瞎,老用户变了更抓瞎 Meta 的方案:PAHF —— 一个带"记忆"的持续个性化框架 双通道反馈:行动前问清楚 + 行动后学教训 机器人操作和在线购物两个场景下,学习速度提升 3-5 倍

智能体的"失忆症"

想象你雇了个助理,刚开始你说"我要浓缩咖啡"。

他记住了,每天给你浓缩。

一个月后你想换口味,说"今天要美式"。

他说"好",第二天又给你端来浓缩。

你再说一次,他点头,第三天还是浓缩。

这是死记硬背,不是智能。

现在的 AI 智能体就是这么个状况。

Meta 这篇论文说的就是这事儿:

Modern AI agents are powerful but often fail to align with the idiosyncratic, evolving preferences of individual users.

AI 很牛,但它不懂你。

更惨的是,它不会学。

PAHF:给智能体装个"记忆条"

Meta 提出的方案叫 PAHF(Personalized Agents from Human Feedback)。

其实就是给智能体装了个"记忆条"。

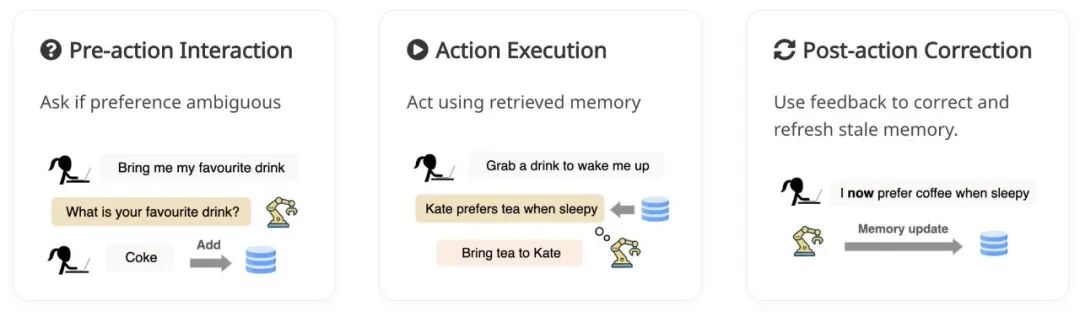

三个步骤:

行动前,不确定就问

“老板,您今天要浓缩还是美式?”

这一步能避免 90%的乌龙。

行动时,翻翻记忆本

查一下上次老板喝什么,当时高兴不高兴。

行动后,挨打要立正

被骂了就记下来:老板换口味了。

被夸了也记下来:这事儿我干对了。

把"你的偏好"当成一个活文档,实时更新,随时查阅。

这听起来简单,但行业里缺的就是这个。

两个反馈通道

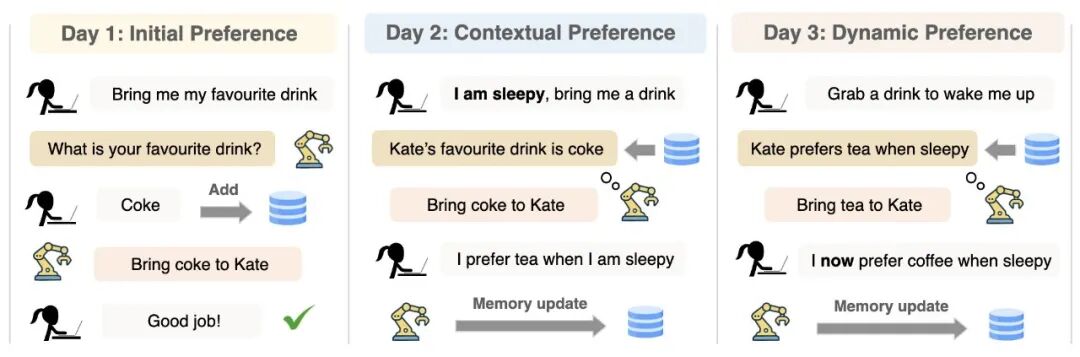

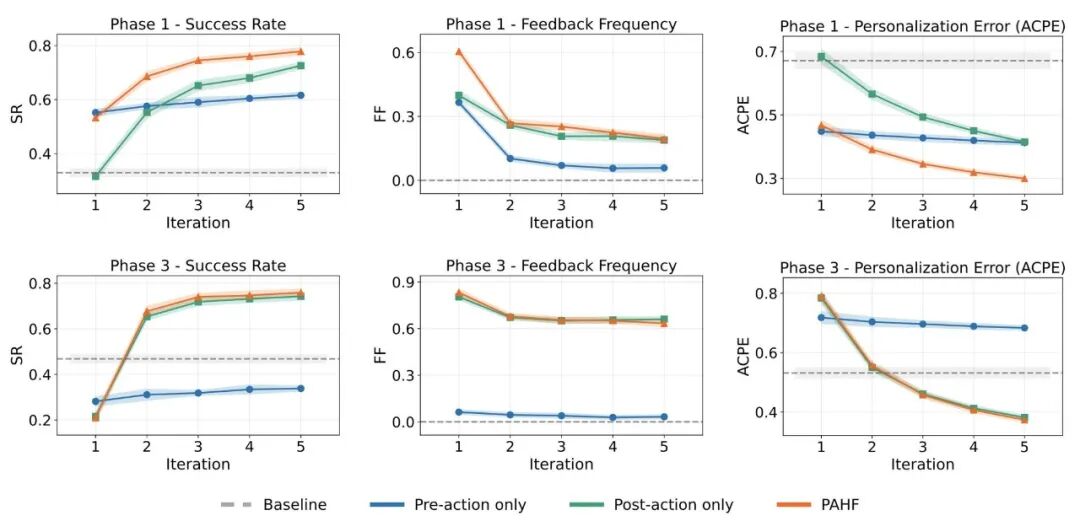

论文里有个对比实验。

他们测试了三种模式。

模式 1:只有行动前反馈

只问不记。

刚开始挺好,错误少。

但等你口味变了,它就崩了。

因为它还在用你三个月前的"老记忆"。

模式 2:只有行动后反馈

闷头干,错了再改。

能适应变化,但刚开始错误率极高。

像个新手,全靠试错来学习。

模式 3:PAHF(双通道)

行动前问清楚,行动后学教训。

既快又稳。

论文里的数据:

Pre-action alone:早期错误低,但适应能力差 Post-action alone:适应快,但早期错误率高 PAHF:两全其美

这不就是我们在做产品时天天讲的东西。

用户调研(行动前)+ 数据分析(行动后)+ 快速迭代(持续更新)

换了个 AI 的皮,本质还是那个道理。

机器人学叠衣服,AI 学买衣服

Meta 做了两个真实验。

场景 1:机器人叠衣服

模拟环境里的机器人,按照你的偏好叠衣服。

颜色怎么排、怎么折叠、放哪儿。

用了 PAHF 之后:

5 次交互就能学会你的基本偏好 当你突然说"换种叠法",它 3 次就能适应 相比之下,不用记忆的方法需要 15-20 次

场景 2:在线购物助手

模拟你买东西,AI 根据你的偏好推荐商品。

今天喜欢便宜货,明天追求品质,后天又要环保。

PAHF 的表现:

初始学习速度提升 3 倍 偏好变化后,适应速度提升 5 倍 在"未见过的商品"上泛化能力更好

这是把 倾听用户 + 持续改进 这套老生常谈的东西,真正落到了实处。

我的看法

前几年大家都在讲 AI 要"理解人类"、“懂你”。

讲得天花乱坠,搞得好像 AI 明天就要成精似的。

ChatGPT 再聪明,它也记不住你昨天跟它说了啥。

Midjourney 再厉害,它也不知道你审美从极简风变成了赛博朋克。

问题不是 AI 不够强,是它没有"成长性"。

一个不会成长的助手,哪怕初始能力再强,用久了也是垃圾。

你在变,它没变。

这才是 AI 智能体最大的短板。

Meta 这篇论文厉害就厉害在,它没去搞什么"让 AI 更聪明"的虚招。

而是老老实实解决了"记忆"和"学习"这两个最基础的问题。

最大的创新,往往就是把最朴素的事情做到位。

对产品人的启发

我琢磨了一晚上,觉得这事儿对我们的启发有三点。

停止追求"万能 AI"的幻想

别想着训练一个模型就搞定所有用户。

每个用户都是独一无二的,偏好还在变。

承认差异,拥抱变化。

产品要做"活的"

不是上线个功能就完事了,而是要持续观察用户行为,快速调整。

PAHF 的本质,就是产品迭代的自动化。

把"用户反馈→产品改进"这个过程,从"人做"变成"AI 自动做"。

数据隐私要提前想清楚

给每个用户建独立记忆,听起来很美好。

但这些数据存哪儿?谁有权限?怎么保护?

Meta 论文里没细说,但这是绕不过去的坎。

20 年后

写这篇文章的时候,我突然想起一件往事。

10 年前,我刚入行做网站。

那时候每个用户都有自己的"偏好设置"——字体大小、背景颜色、默认排序。

我们把这些存在数据库里,每次登录就调出来。

10 年后,我们又在给 AI 做同样的事。

历史总是螺旋上升的。

从"手动记忆"到"自动学习",从"静态偏好"到"动态适应"。

技术在变,但本质没变。

理解用户,尊重用户,和用户一起成长。

这才是好产品的底色。

参考资料

[1] Learning Personalized Agents from Human Feedback: https://arxiv.org/abs/2602.16173

[2] facebookresearch/PAHF: https://github.com/facebookresearch/PAHF

[3] personalized-ai.github.io: https://personalized-ai.github.io

[4] @kaiqu_liang: https://x.com/kaiqu_liang/status/2024563908447473799

<原文链接:https://mp.weixin.qq.com/s/ahv6Fp35iEEBdQUD9Fh_mQ

暂无评论内容