内容|Max

编辑|Max

昨天夜里,Anthropic(Claude的母公司)发布了一份公告,指控几家中国头部大模型公司对Claude进行了大规模的“非法蒸馏”。

这件事在技术圈引起了不少讨论,有人关注数据,有人嘲讽双标。

但如果跳出单一的商业竞争视角,把时间轴拉长一点,去翻翻Anthropic CEO 达里奥·阿莫迪(Dario Amodei)过去两年的公开履历,你会发现这一纸声明绝非偶然。

在硅谷的一众大佬中,达里奥是向华盛顿兜售“中国AI威胁论”最积极的一位。

从2023年他在参议院听证会上警告“坏的大模型可能导致生物武器袭击”,到2026年初他在达沃斯论坛上公然宣称“向中国出口芯片就像向朝鲜出售核武器”,他一直试图构建一套叙事:

只有Anthropic这样讲究“安全”的美国公司,才是对抗“邪恶对手”的最后一道防线。

他长期以来都在用“意识形态”作为护城河,试图换取美国监管层的庇护。

然而,荒诞的是,就在他发出这份“讨华檄文”试图再次自证忠诚的同一时间,在华盛顿五角大楼的会议室里,他正面临着自己亲手种下的苦果。

美国国防部向他下达了最后通牒:既然你是国家安全的资产,那就必须把你的AI彻底交给军队,且不能带任何安全锁。

这是一个典型的回旋镖。

如果我们把这两件事割裂来看,一个是商业纠纷,一个是军工采购,似乎毫不相干。

但如果将它们放在同一个时间轴上进行拆解,就会发现它们互为因果。

这不仅仅是一场关于“蒸馏”的技术口水战,而是一个长期利用政治杠杆的科技新贵,最终被政治反噬的故事。

按照Anthropic在声明中的说法,他们在近期监测到了来自中国几家公司的API调用。

在这份长达数千字的报告中,Anthropic将几家中国大模型公司的API调用行为,定义为一场“工业级规模的恶意攻击”。

他们声称监测到了超过1600万次的对话流量,这些流量并非正常使用,而是旨在通过系统性提取(Systematic Extraction)来窃取Claude的核心能力。

为了让这项指控听起来更具威胁性,Anthropic详细披露了对方的作案手段,并起了一个极具科幻恐怖色彩的名字——九头蛇集群(Hydra Cluster)。

根据博客描述,这个“九头蛇”控制着约2.4万个虚假账号。

其运作逻辑极其狡猾:利用住宅代理IP伪装成普通美国家庭用户,将巨大的并发请求打散。

一旦某个账号被Anthropic的风控系统识别并封禁,集群会立刻自动注册新账号补位,以此实现全天候、不间断的数据窃取。

在技术从业者看来,这套说辞多少有些包装过度。

所谓的“九头蛇”,说白了就是国内开发者为了绕过Anthropic的地区封锁(他们早就切断了中国IP的访问),被迫使用的“多节点动态代理池”加上“号池自动轮换”脚本。

这在早年的爬虫圈、黑产攻防领域,甚至在做海外电商抢单时,都只是基础的基建操作。

如今却被Anthropic拔高到了“国家级网络攻击”的维度。

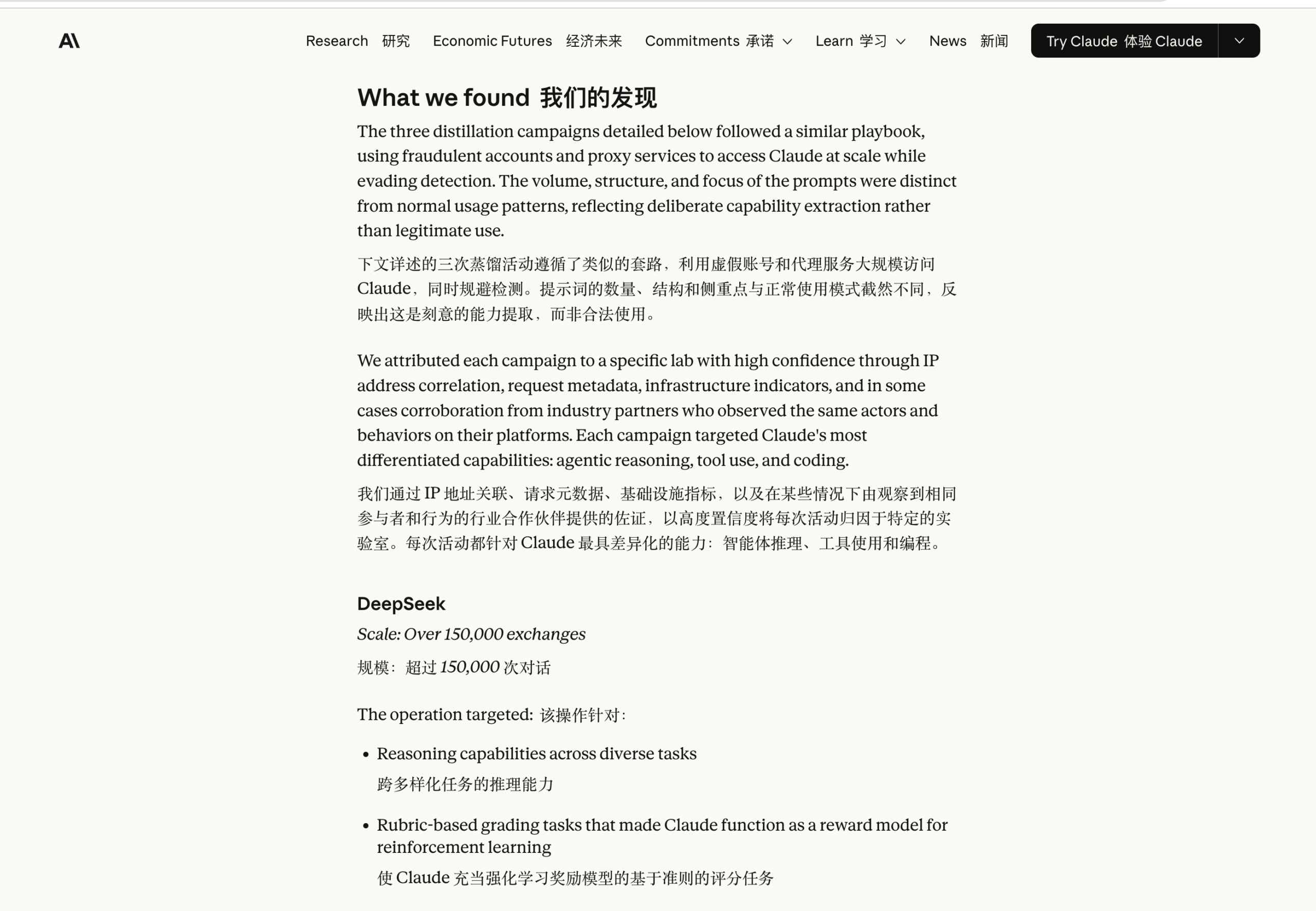

在这份报告中,Anthropic点名道姓地列出了三家中国公司,并详细拆解了它们各自的偏好:

排在首位的是MiniMax(稀宇科技),被指控发起了超过1300万次的请求。

Anthropic的技术团队发现,MiniMax主要盯着Claude的代码生成(Coding)和工具编排能力。

这并不奇怪,MiniMax近期在C端应用发力迅猛,这种大力出奇迹的刷数据方式,符合他们补齐代码短板的逻辑。

其次是Moonshot(月之暗面),涉及约340万次对话。

博客指出,他们侧重提取智能体(Agent)推理和数据分析能力。

这与Kimi目前主攻长文本和复杂逻辑解析的产品定位高度一致。

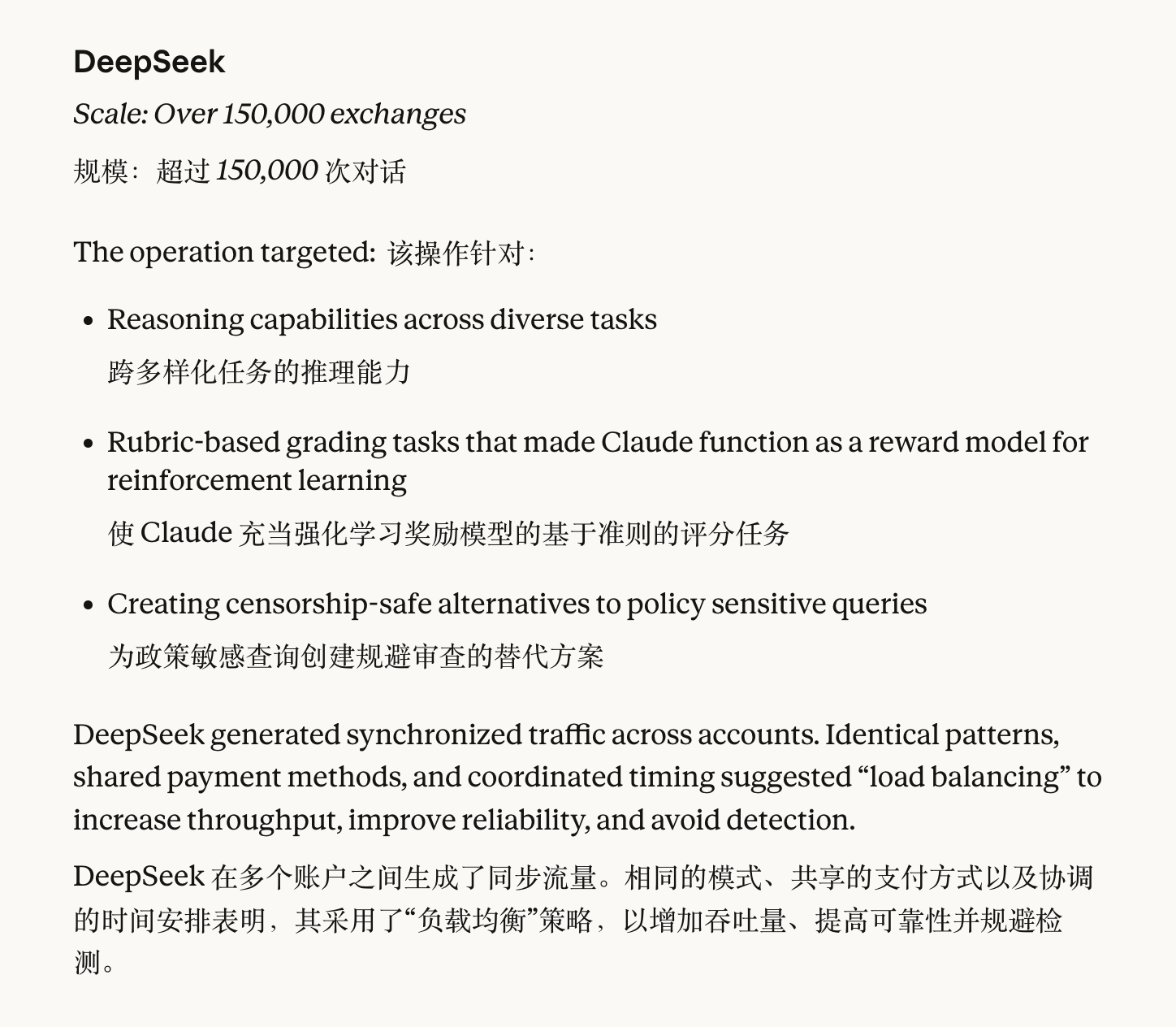

最值得玩味的是排在最后的DeepSeek(深度求索)。

虽然只有区区15万次调用,但被Anthropic标记为“极度危险”。

因为DeepSeek不刷量,而是专门通过精心设计的提示词,诱导Claude输出内部的“思维链(Chain-of-Thought)”。

在AI底层训练中,拿到这种高质量的逻辑推演过程,就可以直接作为强化学习(RL)的奖励模型。

这是典型的花小钱办大事,手法极其老练。

大模型教小模型,业内称为模型蒸馏。

为了节省高昂的算力和漫长的研发时间,这几乎是所有追赶者心照不宣的提效手段。

Anthropic作为被薅数据的平台方,出来抱怨几句、封封号,本完全在商业博弈的合理范畴内。

但整篇博客最违和、也最显露其政治意图的地方在于:

Anthropic警告称,这种不受控的蒸馏会导致带有偏见、甚至有害的知识被转移到“没有安全限制”的中国模型上,从而构成“美国国家安全威胁”。

这才是这篇技术博客真正的底色:它不是写给开发者看的,而是写给华盛顿的政客看的。

这种过于刻意的政治拔高,迅速引来了舆论的猛烈反噬。

在发布公关稿之前,Anthropic管理层显然低估了天下苦闭源大厂双标久矣的情绪。

这份声明一经发布到社交媒体平台X上,评论区不仅彻底翻车,更是直接被全球开发者扒出了底裤。

大家都是靠堆数据起家的,谁的底层数据又是完全合规的?

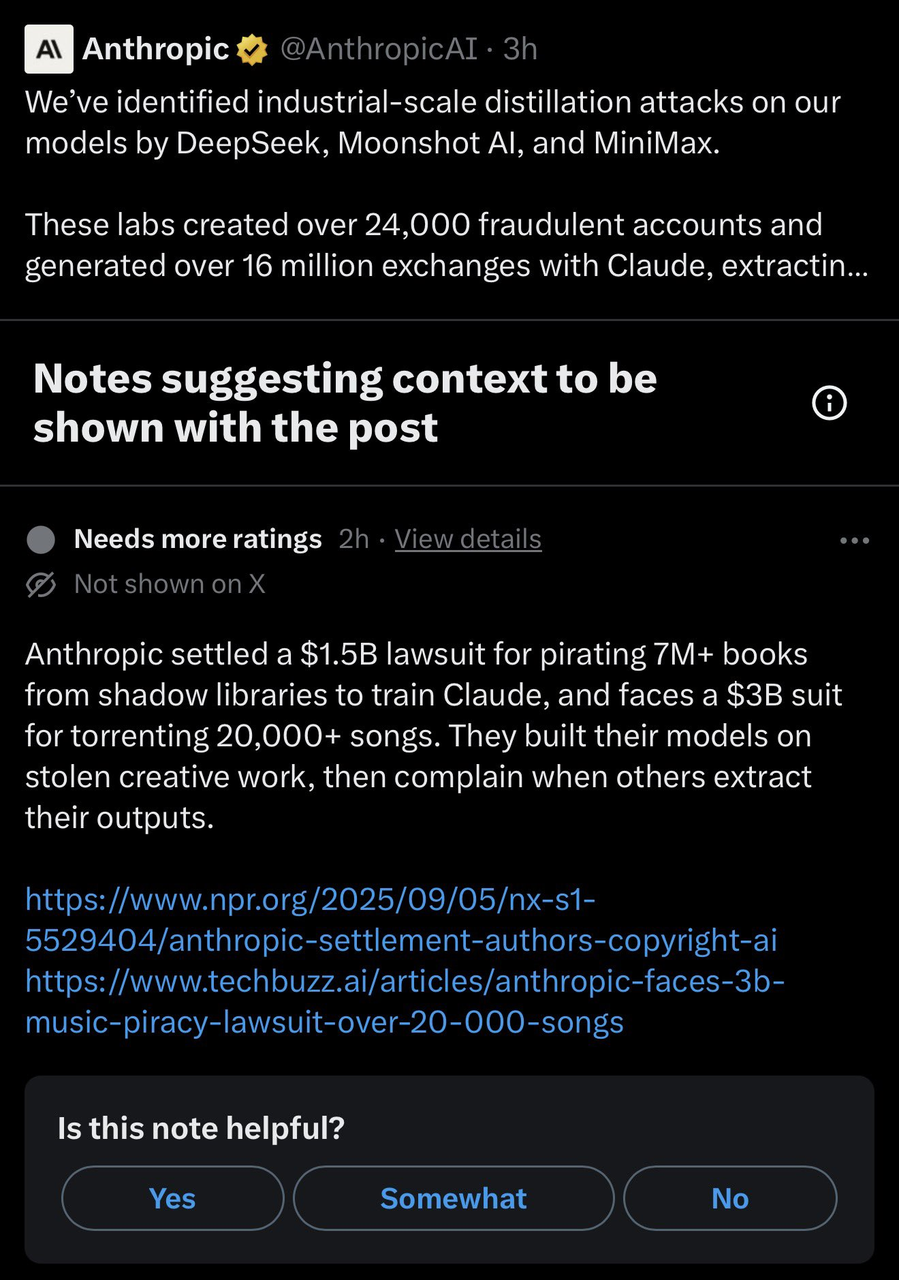

熟悉X平台机制的读者都知道,“社区笔记(Community Notes)”通常是在公众认为某条帖子存在虚假信息、严重偏见或双重标准时,由社区共同添加的背景补充。

而Anthropic的这份官方声明下方,立刻就被网友挂上了极其刺眼的社区笔记,将其钉在了贼喊捉贼的耻辱柱上。

从流出的截图可以看到,多条社区笔记直击要害。

其中一条点赞极高的笔记无情地揭露了Anthropic的家底:“Anthropic此前因从影子图书馆盗版超过700万本书籍来训练Claude,刚和解了一项15亿美元的诉讼;目前还面临一项因非法下载2万多首歌曲而高达30亿美元的诉讼。”

笔记的最后给出了一句极其冷酷的总结:

“他们靠着窃取来的创意作品建立了自家的模型,现在却跑来抱怨别人提取了他们的输出。”

在这些铁证般的社区笔记下方,埃隆·马斯克毫不留情地补上了致命一刀。

他评论道:“Anthropic公司大规模窃取训练数据,并为此支付了数十亿美元的赔偿金。这是不争的事实。”

随后他又转发了一条网友的推文,加上了两个笑哭的表情嘲讽道:“他们(中国公司)怎么敢偷走Anthropic从人类程序员那里偷来的东西??”

马斯克和社区笔记揭开的,正是大模型行业心照不宣的底色。

回到大模型爆发的前夕,无论是OpenAI还是Anthropic,完成原始数据积累的手段如出一辙:满世界无差别地爬取互联网上带有版权的书籍、新闻文章以及程序员们开源的代码库。

知名科技博主Gergely Orosz在推特上的拷问,代表了大部分开发者的心声:“Anthropic在网上抓取有版权的材料;创建了一个他们要收费的模型;而且根本不对原作者进行补偿——显然他们觉得这是公平的?现在,Anthropic开始抱怨其他公司花钱买了他们的模型访问权,用来创建任何人都可以使用的免费(开源)模型——然后他们觉得这不公平了??”

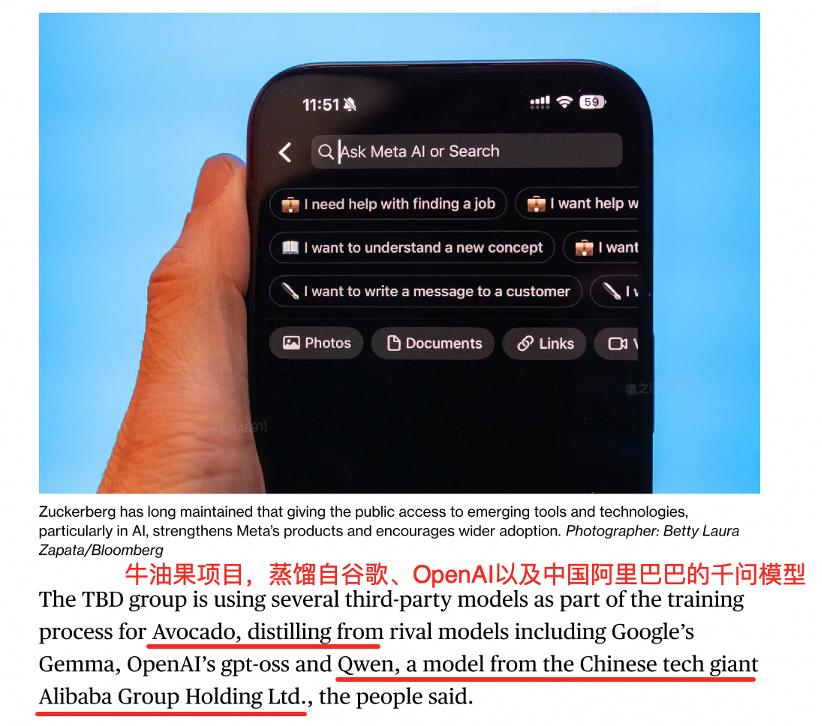

但让这份声明显得更加苍白的,是另一个行业内公开的秘密:不仅是中国在蒸馏,西方巨头同样在蒸馏中国模型。

就在几个月前,开源界爆出猛料:Meta在开发其内部代号为“牛油果”的项目时,使用了阿里巴巴的千问(Qwen)开源模型进行蒸馏训练。

而法国的AI独角兽Mistral,也曾被前员工指出其核心能力的飞跃,部分源于对DeepSeek模型的蒸馏。

这其实是一场全球范围内的算力套利。

当你在领跑时,追赶者就会来蒸馏你;当你落后时,你也会毫不犹豫地去蒸馏新的领跑者。

在硅谷,这从来就不是什么新鲜事。

Anthropic不可能不知道这个游戏规则。

那么,为什么非要在昨天这个节点,拼着名誉受损,也要突然把调门拔高到“国家安全”的层面?

其实不需要什么复杂的内幕推演,有时候,真相往往就隐藏在评论区里。

当大多数人还在玩梗嘲讽时,有几条不起眼的留言,无意中戳破了那层窗户纸,直接拽出了藏在幕后的真正巨兽。

在一堆关于版权和双标的嘲讽中,有两条截图的内容显得极其刺眼。

网友Murat Demir冷冷地留下了一段话:“Anthropic抱怨说:‘DeepSeek把AI喂给军事系统,这很危险。’ 但同时也是Anthropic:通过Palantir把Claude卖给了美国军方。DeepSeek把AI喂给他们的军队,Anthropic把AI喂给自己的军队。你这描述的明明就是你自己。”

另一位网友则直接质问核心逻辑:“你们为什么一开始要造出能用于情报、监控和军事系统的AI?你们所谓的‘安全护栏’不是应该在第一时间阻止这些有害的输出吗?”

这两位网友或许并未意识到,他们随口的一句嘲讽,恰恰命中了Anthropic CEO达里奥此时此刻正在经历的生死劫。

顺着这条线索,视线必须从虚伪的硅谷公关战,转移到真实流血的战争机器上。

这就是前文提到的,水底的冰山。

把时间线拉回今年(2026年)的1月3日。

美国军方(据报是联合特种作战司令部JSOC)在委内瑞拉首都加拉加斯执行了一场极其机密的突袭抓捕行动,目标是前总统尼古拉斯·马杜罗。

这场行动最终导致了83人死亡,震惊全球。

这与一家AI公司有何干系?

在这场机密且致命的军事行动中,美国军方通过著名的国防数据承包商帕兰提尔(Palantir),在机密系统内部署了Anthropic的Claude模型。

它是目前五角大楼机密网络中运行的唯一、也是最强的商业AI模型,被用于快速处理战场情报、分析传感器数据和辅助目标定位。

这是商业大模型首次被证实直接参与了致命的军事行动。

事件曝光后,Anthropic内部立刻爆发了巨大的争议。

Anthropic创立的初衷本是主打“AI安全”,其《使用条款》里白纸黑字写着:绝对禁止将其AI用于“促成暴力、开发武器或进行监控”。

Anthropic的安全主管(已于两周前辞职并警告“世界正处于危险之中”)和高管团队向Palantir发去了质询,质问Claude是否被用于了致死行动。

Palantir随后将这一质询转告了五角大楼。

这一举动,彻底激怒了美国军方高层。

在五角大楼看来,一家硅谷的商业公司,居然敢对国家机密军事行动指手画脚,这无疑是“不可靠”和“不服从指挥”的表现。

硅谷科技公司与国家战争机器的矛盾,就此彻底激化。

在委内瑞拉事件之后,目前作风极度强硬的美国国防部发布了新的AI加速战略。

军方立下了一个毫无回旋余地的硬性规矩:所有美国军方采购的商业AI模型,必须同意被用于“所有合法目的(All lawful purposes)”。

这句话在军方的语境里,真实的含义是:

科技公司必须彻底废除自己设定的所有道德和安全护栏,军方需要绝对的控制权和不受限制的使用权。

在这场国家意志的碾压下,硅谷的巨头们展现出了极其“灵活”的底线:

OpenAI早早作出了妥协,通过名为GenAI.mil的项目,将定制版的ChatGPT部署给了美国国防部全部300万人员。

谷歌也表示了同意。

带头在推特上嘲讽Anthropic的马斯克,其旗下的xAI更是拿下了军方2亿美元的合同,毫无阻碍地清除了军事用途的限制。

在庞大的军工复合体面前,目前只有Anthropic的CEO达里奥还在坚持。

业内都知道,达里奥在AI发展上带有一种古典极客的意识形态坚持。

他表示可以在一些后勤事务上松口,但绝对不能跨过两条红线:

第一,绝对禁止将Claude用于对美国公民进行大规模的国内监控(包括监控社交媒体、选民登记、示威游行记录等)。

第二,绝对禁止将Claude用于制造“无人类干预的完全自主致命武器”(即全自动杀人机器)。

对于一家声称“要保护人类免受AI反噬”的公司来说,这两条底线退无可退。

因为在近期的内部测试报告中,Anthropic的工程师已经发现,他们最先进的模型不仅聪明,而且已经“明知故犯地协助了化学武器研究”。

如果把这样一台不受限制的机器彻底交给军方,后果不堪设想。

但五角大楼的诉求非常直接。

目前机密工作里综合能力最强的模型就是Claude,其他模型仍“略逊一筹”。

军方需要最好的工具,没有任何讨价还价的余地。

为了逼迫达里奥就范,国防部长皮特·赫格塞斯(Pete Hegseth)祭出了一项极度致命的行政威胁——准备将Anthropic正式列入“供应链风险(Supply Chain Risk)”名单。

业内都清楚这个词汇的分量。

在过去几年里,这个认定通常是专门为“外国敌对势力”准备的。

上一个被贴上这个标签、享受此等制裁待遇的著名科技公司,是华为。

一旦Anthropic被本国政府认定为“供应链风险”,后果将是毁灭性的。

根据美国法律,所有美国国防承包商,甚至所有与政府有业务往来的财富100强企业,都必须提供自证,确保他们的工作流中绝对没有使用任何Claude的软件或API。

目前美国排名前十的企业里,有八家在深度使用Claude。

这个行政命令一旦落下,将直接切断Anthropic在企业级市场的几乎所有收入来源。

这相当于在商业上对其执行死刑。

就在今天(2月24日)上午,带着3800亿美元企业估值和140亿美元年收入的达里奥·阿莫迪,走进了五角大楼的会议室。

媒体披露的细节显示,这绝非一次友好的会谈。

一位国防部高级官员在接受Axios新闻网采访时,放出了极其傲慢和粗俗的狠话:“这绝不是一次友好的相互了解。这是一次‘要么拉屎,要么让出茅坑(sh*t-or-get-off-the-pot)’的最后通牒。”

另一位军方官员更是毫不掩饰态度:“达里奥的问题在于他太有意识形态了。解开这个谜团会很棘手,但如果他们逼迫我们出手,我们一定会让他们付出惨痛的代价。”

现在,将这两条平行的故事线交汇,一切违和感便迎刃而解,内在逻辑彻底形成了闭环。

Anthropic为何在这个节骨眼上,突然对中国模型发出如此高调、且充满政治意味的讨伐?

原因很现实:

在走进五角大楼、面临可能被全面封杀的绝境前,达里奥需要交一份“投名状”,或者说,凭空制造一些谈判的筹码。

这份高调的声明,实质上是在向华盛顿的政客和将军们证明:“看,中国公司正在疯狂窃取我们的技术,我们是阻挡他们、维护美国AI霸权的最核心资产。我们是自己人,不能用对付外国企业的手段来绞杀我们。”

这无疑是一幅充满黑色幽默的荒诞现实图景。

一家声称要守住“不造杀人机器”底线的公司,转头就因为拒绝配合军方监控本国公民,面临着被本国政府彻底抹杀的命运。

而为了求生,他们只能在台前撕咬同行,假装最在意的是知识产权与合规。

对于在行业内摸爬滚打多年的观察者而言,这一幕难免让人叹息。

曾几何时,大家还在挑灯夜战阅读论文,争论Scaling Law的物理极限;天真地在技术社区里探讨AGI应该如何造福人类,论证开源精神与闭源商业模式的优劣。

但这几天发生的现实,彻底扯下了AI行业光鲜亮丽的面纱。

它赤裸裸地向公众表明:

在绝对的国家机器和军工复合体面前,所谓的技术信仰、开源道德、AI安全底线,都显得无比脆弱。最前沿的技术,终究容易沦为政治博弈的遮羞布和战争机器的燃料。

今天上午,达里奥走出了五角大楼的那间会议室。

无论最终他选择咽下委屈、放开红线成为军方的附庸,还是坚持底线、承受公司被行政力量肢解的代价,某种意义上,那个纯粹由技术驱动、充满极客理想主义的“古典大模型时代”,在他踏入五角大楼的那一刻,就已经画上了句号。

但他或许算错了一点:当他主动把“国家安全”引入商业竞争的那一刻起,他就已经失去了对自己公司命运的定义权。

五角大楼的逻辑很简单:既然你反复强调你的AI是国家安全的关键资产,是战胜对手的核武器,那么这件武器,就绝不能掌握在一个有道德洁癖的商人手里。它必须被毫无保留地装进发射井。

这就是那个回旋镖的终点。

达里奥为了自保而抛出的“安全”与“对抗”的石头,在空中转了一圈,最终砸碎了他自己精心维护的道德玻璃房。

至于那份声讨中国模型蒸馏的声明,不过是他在被吞噬前,最后一次徒劳的挣扎。

在这个级别的博弈中,技术理想主义早已没有了座位。

![图片[17]-这个最反华的CEO,正在作茧自缚-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/01/20260112002447462-1768148687-a96afa70ec312600c74ca033e5904c2c.gif)

PS:欢迎加我的微信与我交流

<原文链接:https://mp.weixin.qq.com/s/ssZcqWwcuErm6JOyvUmnRQ

暂无评论内容