AIPress.com.cn报道

就在刚刚,拳打字节Seedance2.0,脚踢快手可灵的AI视频生成模型Happy Horse 1.0开源了。

![图片[1]-刚刚!超越Seedance2.0的模型居然开源了!-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260409001607664-1775664967-bc760a62d63d63d5e63673d13c93f678.png)

目前在官网可通过文本生成和图片生成两种方式体验生成视频。不同模型对制作时长的限制各不相同。

![图片[2]-刚刚!超越Seedance2.0的模型居然开源了!-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260409001610623-1775664970-c1e08562a26f2d65360c30960a685c87.png)

可选4种模型。

![图片[3]-刚刚!超越Seedance2.0的模型居然开源了!-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260409001613373-1775664973-3abd05fe001d6c6da6919d75e25bf6c3.png)

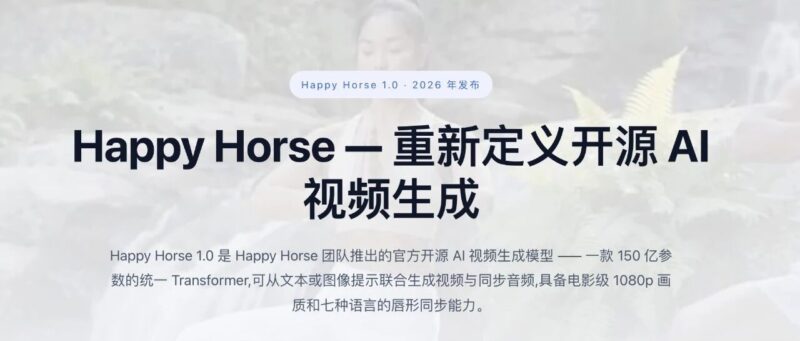

Happy Horse 1.0的核心卖点,是把视频和音频的生成彻底合并进了同一个流程。大多数开源视频模型的工作方式是:先生成一段没有声音的视频,再找另一个模型配音,再找另一个工具做口型对齐,几道工序下来,时间和误差都在叠加。而Happy Horse 1.0用一个统一的Transformer同时处理视频和音频,一次前向推理直接输出带声音的成片,口型、脚步声、环境音全部在同一个过程里生成,不需要任何后期拼接。

模型参数量是150亿,架构上是纯自注意力Transformer,没有交叉注意力,没有独立的音频分支,也没有专门的条件网络。整体设计刻意追求极简——把所有模态(文本、图像、视频、音频)的token拼成同一个序列,让模型在去噪过程中自己学会跨模态对齐。

在结构上,40层Transformer采用了一种“三明治”布局:头4层和尾4层用模态专属的投影层处理各自的输入输出,中间32层则是所有模态共享参数。实际的跨模态推理就发生在这32层里,这也是整个架构参数效率最高的地方。此外,每个注意力头都有一个可学习的标量门控,用sigmoid激活,专门用来稳定多模态联合训练时的梯度——毕竟音频损失和视频损失同时反传,很容易互相打架。

速度方面,模型采用了DMD-2蒸馏技术(Distribution Matching Distillation v2),把去噪步数从通常的25到50步压缩到了8步,同时不需要无分类器引导(CFG),这一项本身就能砍掉将近一半的计算量。再配合MagiCompiler全图编译运行时带来的约1.2倍额外加速,在单张H100上,生成一段1080p视频只需要大约38秒,256p的预览版本则在2秒左右就能出来。

同时,模型原生支持英语、普通话、粤语、日语、韩语、德语和法语七种语言唇形同步,这些语言的口型、语调和语音时序是和视频一起联合训练出来的,不是后期贴上去的。

Happy Horse 1.0的公开亮相方式可谓是神秘感十足。它最早以匿名神秘模型的身份出现在 Artificial Analysis 视频竞技场排行榜上,和字节、Kling、Google等闭源商业产品同台竞技,靠盲测投票定排名。社区里有人注意到它似乎来自亚洲,带有原生音频生成能力,运动质量和最新版Kling处于同一梯队。到现在,它才正式公布自己的身份。

在开源视频模型的横向对比里,Happy Horse 1.0是目前唯一一个原生支持联合音视频生成的,其他主流开源模型,如Wan 2.2、HunyuanVideo、LTX-2、CogVideoX,全部只输出无声视频。在去噪步数和生成速度上,它也是同类里最激进的。

在Artificial Analysis的基准测试里,Happy Horse 1.0的视觉质量评分4.80,文本符合度4.18,物理逼真度4.52,三项指标都排在OVI 1.1和LTX 2.3前面。胜率上,对OVI 1.1是80%,对LTX 2.3是60.9%。

![图片[4]-刚刚!超越Seedance2.0的模型居然开源了!-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260409001614624-1775664974-01c71880180d3b18ededde976040a6ec.png)

跟闭源商业服务比,Sora、Veo、Kling、Seedance这些都是按调用付费、不开放权重、不能自托管、不能微调。Happy Horse 1.0的权重完全开放,下载到自己的机器上就能跑,支持在自己的数据上微调,商用不受限制。参数量150亿,对比LTX 2.3的220亿,体量更小但综合测评分更高。

目前权重和推理代码尚未正式发布,仓库显示即将上线。已经可以在HappyHorse官网上用浏览器试用,不需要安装,不需要自备GPU,有免费额度可以测试文生视频、图生视频和音视频生成。

![图片[5]-刚刚!超越Seedance2.0的模型居然开源了!-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260409001616644-1775664976-399fda12ad3140652cd2c85df2b55910.png)

硬件方面,官方公布的基准测试数据基于单张NVIDIA H100(80GB显存)。A100 80GB同样可以跑完整质量,只是速度慢一些。RTX 4090这类消费级显卡的支持方案据说会在正式发布时一并公布,配合蒸馏模型和降分辨率设置应该能跑起来,但具体数据还没出来。

技术报告会随模型权重一起发布。

🔗相关链接:

1.HappyHorse GitHub:https://github.com/brooks376/Happy-Horse-1.0?tab=readme-ov-file#happy-horse-10

2.HappyHorse网站:https://happyhorses.io/zh/#deploy

3.HappyHorse官网(可生成视频):https://happyhorse.video/zh

相关阅读:

挑战Seedance2.0!阿里HappyHorse-1.0登顶AI视频测评榜首

点击关注AIPress公众号:

扫码加入AIPress读者群:

访问AIPress网站,请点击以下“阅读原文”链接,或访问网址:aipress.com.cn

![图片[6]-刚刚!超越Seedance2.0的模型居然开源了!-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260409001621219-1775664981-978155be7c935f11cf2495298a853069.jpeg)

<原文链接:https://mp.weixin.qq.com/s/13bRauWaldA6bpzaDAFo_g

暂无评论内容