有一家做AI漫剧的团队,员工原来是中午上班,干到凌晨1点下班。不是996,是这行的作息就这样,算力便宜,排队的人少。

然后Seedance 2.0发布了。

凌晨1点,官方平台上还有上万人排队。他们把上班时间改成了凌晨3点。

这可以说是AI时代最新的魔幻现实主义了。同一篇报道里提到,有创作者截图显示队列前面有13万人,预计等待时间「未知」。

一个视频模型把人逼成这样,上一次见到类似的场面还是排队退ofo押金。

我没排队。我2分钟就用上了。

不是什么特殊渠道,是因为我用的LibTV。

上个月我写过LibTV,当时主要聊它「两扇门」的设计:一扇给人用的画布,一扇给Agent用的Skill接口。那篇文章发的时候LibTV刚上线一天,我让龙虾通过Skill自动做了一支小猫补光灯的宣传视频,整个过程没打开任何界面,Agent自己跑完了从剧本到成片的全流程。

然后最近用的时候,发现LibTV上有一个叫StarVideo 2.0的模型。用的时候就觉得这个模型的效果好得有点离谱,不像是一个名不见经传的模型该有的水平。网上也有不少人猜测StarVideo 2.0就是Seedance 2.0。

现在他们终于公布真相了。StarVideo 2.0就是Seedance 2.0。 果然是。

LibTV和字节是深度合作关系,Seedance 2.0的API在LibTV上做了底层适配和优化。这一周我用StarVideo 2.0生成的那些视频,实际跑的就是Seedance 2.0的引擎。而且LibTV在接入层做了专门的优化,效果实测比官方平台直用还稳一些。

具体好多少我没法量化,但有一件事是确定的:在LibTV上用Seedance 2.0,基本不排队,单条生成2到3分钟。

同一个模型。一边是13万人排队、4到5小时等待、凌晨3点上班。另一边是打开就能用、2分钟出片。这个体验差距不需要我渲染。

说说我为什么这么需要AI视频

很多公众号的新朋友可能不知道,我也是个B站UP主。而且最近三天,我每天都发了一条20分钟左右的长视频。

3月29号OpenClaw使用技巧,3月30号DeepSeek V4,3月31号Claude Code源码泄露解读。三条加起来快40万播放。

做过视频的人知道这意味着什么:每条20分钟的视频,里面需要大量的画面素材来配合讲解。屏幕录制只能覆盖一部分,剩下的概念图、流程图、演示动画,全得自己搞。

更要命的是这三条里有两条是赶热点的。Claude Code源码泄露那条,从消息出来到我发视频,中间只有几个小时。如果我要等某梦排队4小时才能生成一个素材,黄花菜都凉了。热点不等人,但好的画面素材又不能对付。

所以我对「好用且快」的AI视频工具有极强的诉求。

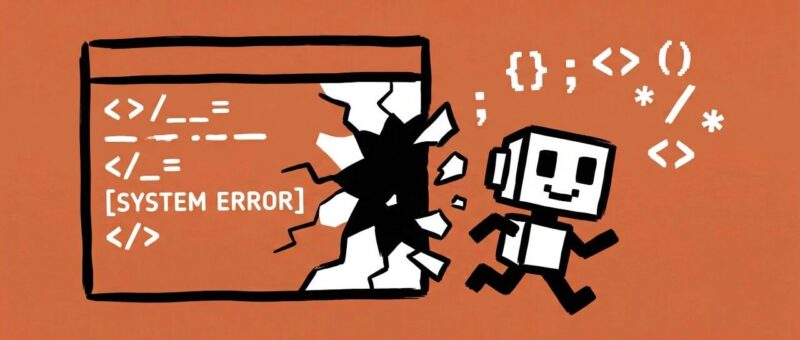

举个真实的例子。写这篇文章的时候我顺手用LibTV的Seedance 2.0生成了一段Claude Code「越狱」的动画素材,小机器人挣扎着冲破屏幕逃跑,不到2分钟就出来了。

看到成品的时候我第一反应是后悔:前天做那条Claude Code源码泄露的视频时,要是已经发现了这个工具,视频的画面呈现还能再上一个台阶。

这也是为什么LibTV上线Seedance 2.0对我来说不只是一个产品更新,而是解决了一个真实的、每天都在面对的痛点。

Seedance 2.0猛在哪

如果你最近没怎么关注AI视频这块,简单说几个点。

2024年2月我在即刻发过一条动态,大意是「AI视频生成的不可控性太强了,当玩具拼拼凑凑可以,但要做真正消费级的影视内容还差得远」。两年过去,Seedance 2.0基本把我这条打脸了。

Seedance 2.0是字节2月12日发布的视频生成模型,发布当天官方平台排队人数就破了万。几个核心能力:

多镜头叙事。不是生成单个镜头,而是一次性输出包含多个镜头切换的连贯视频,最长15秒。对做短剧、广告片的人来说这是质变,以前要一个镜头一个镜头生成再拼,现在模型自己理解场景转换。

音视频一体化。同步生成对白、环境音和动作音效,唇语同步。不用再额外配音配乐,生成出来就是有声音的完整视频。

角色一致性。这是Seedance 2.0的设计核心,不是事后补丁。给一个角色参考图,后续所有镜头里这个角色的外貌保持一致。做连续剧情的时候主角不会从第一幕到第三幕换了张脸。

首次成功率90% 。行业平均大概20%,也就是以前10次里只有2次能用的,现在10次里有9次。抽卡次数少了,成本就低了。

有个视效总监用Seedance 2.0做了一部2分钟的科幻短片「归乡」,总成本330.6元。很多媒体报道时用的标题是「影视圈被Seedance 2.0打懵了」,挺夸张,但看了作品之后觉得也不算太夸张。

X上也是一大堆科技圈大佬夸赞的。

迪士尼都急了,发布两天后就给字节发了停止函。好莱坞MPA也跟进指控版权侵权。一个模型把好莱坞逼到发律师函,某种意义上也是一种认可。

关于排队和降智

但是呢,最近很多用Seedance 2.0的朋友发现了一个比排队更难受的事:某梦上的生成效果似乎在变差。同样的prompt,前一周还能出相当不错的画面,这一周就开始出现奇怪的变形、光影不对、角色走样。

我跟几个做AI视频的朋友聊了一下,大家感受差不多:高峰期排队的时候,模型「降智」的现象尤其明显。有人猜测是算力紧张时做了降级处理,有人觉得是版本回滚。原因没法证实,但体感上确实不如刚发布那几天。

我在LibTV上用Seedance 2.0跑了差不多一周,没遇到这个问题。经过反复测试,LibTV上的确实是满血版的Seedance 2.0,效果表现稳定。感觉他们不只是接了Seedance 2.0的API,可能还在接入层做了专门的底层优化,实测稳定性和效果优于直接使用官方模型。

这个说法我自己的体感是对得上的:同一个创意方向,用LibTV跑出来的结果一致性更好,废片率更低。

为什么会出现这情况,我个人感觉是因为某梦是面向所有用户开放的消费端产品,每天几百万人涌进来排队,算力就那么多,不排队才怪。

LibTV走的是另一条路。作为深度合作的第三方平台,它通过API接入Seedance 2.0,有独立的算力调度。你可以理解为大家都在挤正门的时候,LibTV走了一条专用通道。

而且LibTV不只是套了个壳。他们在接入层做了优化,针对稳定性和出图效果做了调整。我自己用下来的感受是生成失败率确实低,几乎没有排队,偶尔有几十秒的等待,但不是那种「前面还有13万人」的等待。

对认真做内容的人来说太懂这种生成速度提升带来的生产效率和创作方式的改变了。做一个30秒的广告片,核心镜头可能要反复生成几十次才能挑出满意的。如果每次生成要排队4小时还不确定效果好不好,这个项目可能要花一周。在LibTV上每次2到3分钟,效果稳定,一个下午就能把素材全部跑完。

不只是省时间,是AI总有抽卡的需要,更快的话你就更有机会迭代。排队的时候你不敢试,因为试一次的时间成本太高了。不排队的时候你敢大胆试,试50次也不过两个多小时。创作方式在变。

我更喜欢让Agent帮我跑完全流程

上篇文章我演示过龙虾可以通过LibTV Skill自动完成从剧本到成片的全流程。这次Seedance 2.0的加入,让这条路的终点质量有了明显提升。

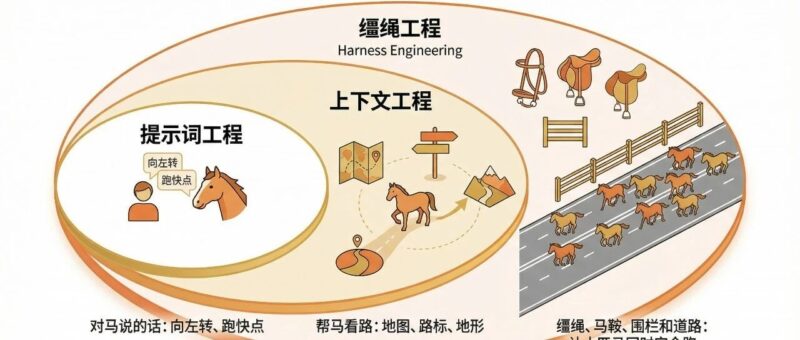

先解释一下LibTV的两种用法。

一种是你完全可以在LibTV的画布上手动操作。

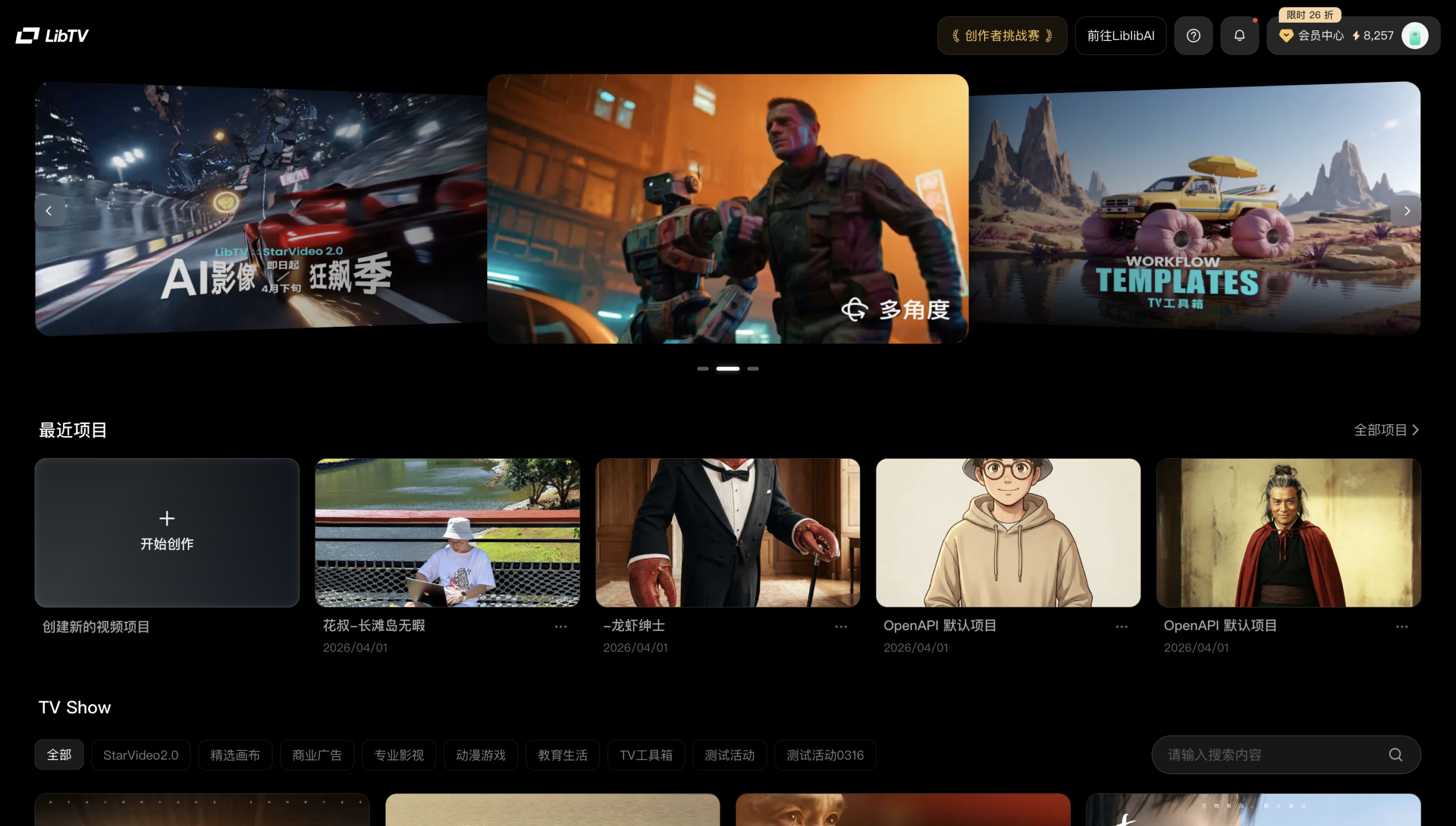

![图片[6]-13万人排队的Seedance 2.0,我2分钟就用上了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260402185159193-1775127119-75ecf47648a30071e9eb154300c4f38c.png)

这是给人类用的模式,所见即所得,拖拖拽拽点点按钮,适合不写代码的创作者。

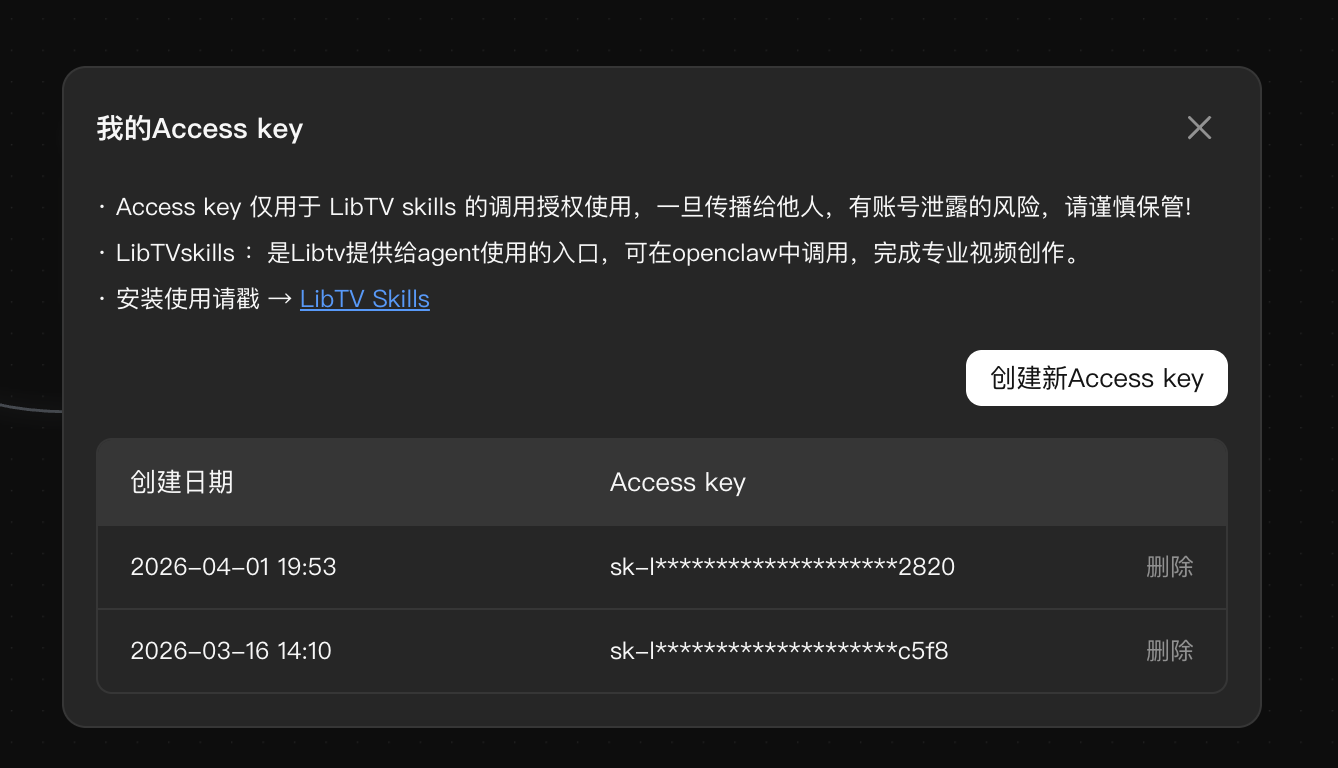

但LibTV还有另一扇门:Skill接口。这是给Agent用的。你在LibTV后台生成一个Access Key,然后把LibTV的Skill安装到你的Agent里(比如龙虾),Agent就可以通过API直接调用LibTV的全部能力,包括Seedance 2.0。

说实话,相比画布模式,我个人更喜欢用Claude Code接入LibTV Skill来操控整个流程。

原因很简单:我在终端里用自然语言告诉龙虾我要什么,它自己去调API、建画布、传素材、写prompt、调Seedance 2.0生成视频。我不用在界面上一个按钮一个按钮地点,整个过程就是跟Agent对话。

比如我让龙虾做一个「全球新闻主播轮番报道橙皮书」 的15秒视频。龙虾先构思了一个单镜头版本,我看了觉得不够有冲击力,跟它说「你完全可以直接去要求多镜头的切换」。它立刻理解了,重新写了一个包含5个镜头快速切换的prompt:CNN风格美国金发女主播、NHK日本男主播、BBC英国主播、央视中国女主播、最后收尾四格画中画加巨大的橙皮书封面闪耀。两个版本都用Seedance 2.0跑的,几分钟后两条视频都出来了。

![图片[8]-13万人排队的Seedance 2.0,我2分钟就用上了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260402185205823-1775127125-6f6f666b5330b8e7142a126ad1f7616c.gif)

这个过程最让我惊喜的不是最终效果,而是跟Agent协作的体验。我不需要自己去想「CNN演播室长什么样」「NHK的布景风格是什么」这些细节,我只要说「全球新闻主播轮番报道」,CC自己就把5个国家的演播室风格、主播形象、画面构图全想好了。我能做的最有价值的事就是在它给出方案后判断「这个好不好」,不好就让它换一种。

对做内容的人来说这意味着什么?你不需要学任何镜头语言、分镜设计、视频剪辑。你需要的是品味,是知道「这个好不好」的判断力。创意是你的,执行交给Agent。

画布模式和Skill模式不矛盾。画布适合需要精细控制每个镜头的专业创作者,Skill适合像我这样想要「一句话启动,当甲方审片」的人。而且两者的结果是互通的,Agent通过Skill生成的内容会自动铺在画布上,你随时可以打开画布去手动调整某个不满意的镜头。

什么类型最容易做出来

从测试来看有个明确的难度梯度。

产品广告和概念短片是最容易成功的。每个镜头可以相对独立,构图稳定,Seedance 2.0的角色一致性和多镜头叙事能力完全hold住。

动画风格比写实风格容易。 风格化本身会掩盖一些物理细节的不真实,所以如果你想让自己出镜但又不想真人出镜,用动画/漫画IP形象是个好方案。

我自己就是这么干的。我有一个漫画版的花叔形象,渔夫帽+圆框眼镜+米色卫衣。整个流程是这样的:

第一步,把漫画头像上传到LibTV画布。

![图片[9]-13万人排队的Seedance 2.0,我2分钟就用上了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260402185220587-1775127140-d3205ba3e6f9d2074cfe64d7c3ed5b38.png)

第二步,选中这张图,点工具栏里的「角色三视图生成」。不需要写任何提示词,LibTV会自动从你的正面图推演出侧面和背面,生成一组完整的角色设定图。这一步的意义是让后续所有镜头的角色保持一致,不会生成到一半换了张脸。

第三步,继续选中角色图,点「25宫格连贯分镜」。这一步也不需要自己写分镜脚本,LibTV会根据你的角色自动生成25个连贯的场景画面,从街景到公园到咖啡馆,服装体型配色始终一致。相当于一次性把整段视频的关键画面都预览出来了。

![图片[10]-13万人排队的Seedance 2.0,我2分钟就用上了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260402185223390-1775127143-de860fedc057c6e8707ad198689b1e7c.png)

第四步,确认分镜没问题后,选中想要的关键帧,用「图生视频」配合Seedance 2.0生成视频。这时候写一句简单的提示词就行,比如「动漫男生在公园长椅上打开笔记本电脑,镜头缓慢推进,画风温暖治愈,4K画面稳定」。因为前面已经有了角色设定和分镜参考,生成出来的视频一致性比直接文生视频要稳定得多。

这套流程对想做Vlog、个人品牌宣传、课程片头的人来说挺实用的。不用真人出镜,用你的动漫形象就能撑起整段视频。而且整个操作就是在画布上点几下,不需要懂任何专业的视频制作知识。

不要一上来就做多人对话或复杂打斗。口型匹配在多人同框时还不稳定,复杂肢体动作的物理合理性也不是每次都过关。这些是当前所有视频模型的共性边界。不过,LibTV里做一些基础的武侠风格的视频倒也是相当轻松👇还挺有80年代港片那味的~

一个实用技巧:找一个你喜欢的广告片丢进LibTV解析出分镜脚本,然后在这个脚本上换角色换场景。站在别人的专业分镜上做你自己的内容,比从零开始快很多。

正好赶上一波活动

LibTV配合Seedance 2.0上线做了一波限时活动,我自己先冲了一波团队版的旗舰版会员,然后也帮你们了解了下活动详情。

![图片[11]-13万人排队的Seedance 2.0,我2分钟就用上了-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260402185225219-1775127145-977fe7de370ab5f9380f89c79407a20e.png)

具体来说就是4月2日到4月7日:买会员直接赠送Seedance 2.0、可灵O3和可灵3.0的免费使用条数。具体是这样的:

个人版大师年会员赠送Seedance 2.0共5条,旗舰年20条,尊享年60条。可灵O3和可灵3.0也是同样的数量。团队版按席位算,大师年5条/席位,旗舰年20条/席位,尊享年60条/席位。

另外这次还上线了一个新功能:积分商店。首购积分包限时双倍,最高赠3万积分,支持Seedance 2.0消耗。可灵O3+3.0、Lib Nano Pro等顶级模型专享包比原厂低30%。对重度用户来说,积分体系意味着跑模型的边际成本可以压得更低。

对想认真做AI视频的人来说,这个价格加上不排队的体验,可能是现阶段使用Seedance 2.0性价比最高的方式了。

上次文章我说「先装上Skill的人会比别人早一段时间把龙虾练出来」。这次补充一句:先在不用排队的地方把Seedance 2.0用熟的人,等到官方平台的排队问题解决了,他们的经验值已经甩了别人一截了。

LibTV官网:https://www.liblib.tv/

GitHub(Skill包):https://github.com/libtv-labs/libtv-skills

<原文链接:https://mp.weixin.qq.com/s/1QjQ4Ndye0VZwRVD6NGugA

暂无评论内容