本案例来自 ERNIE AI Developer Challenge——我们面向全球开发者举办的 AI 应用创新赛事。来自美国的开发者 Zack Williams 基于百度的文心大模型和飞桨生态技术,构建了一套楔形文字自动转录系统,展示了海外开发者如何利用我们的技术解决真实世界的研究难题。

楔形文字(Cuneiform)是人类最古老的书写系统之一,起源于约5000年前的美索不达米亚地区(今伊拉克一带)。抄写员用芦苇笔在湿润泥板上压出楔形符号,记录了从行政档案、法律契约到文学史诗、占卜记录等各类内容。这些泥板是理解古代文明的核心史料。

目前,全球博物馆和收藏机构中保存着约50万块楔形文字泥板。然而,其中绝大多数尚未被转录和研究。原因在于:

专业人才极度稀缺:全球能够阅读楔形文字的亚述学家数量非常有限(仅数百人)

人工转录极其耗时:每块泥板需要专家逐字辨认,效率极低

物理条件限制:许多泥板严重磨损,表面信息退化严重

数字化程度不均:大部分泥板仅有照片记录,据估计只有不到3%进行过3D扫描

在视觉层面,楔形文字图像本身往往“不可读”——泥板经过数千年侵蚀导致严重磨损,叠加照片中的光照、阴影、反光与泥土颜色等噪声,使得表面几何信息难以从2D图像中可靠恢复,而高质量几何表征(如 MSII)又依赖昂贵且难以规模化的3D扫描。

在符号与数据层面,楔形文字属于非拉丁体系,符号复杂且在长达3000余年的使用过程中发生显著演化,不同时期字形差异巨大,同时单张图像还可能同时包含泥板的正面、反面及边缘,进一步增加解析难度。

面对数十万块"沉默"的泥板,来自美国的开发者 Zack Ovtis 提出了一个愿景:用AI打破瓶颈,让任何一块有照片的泥板都能被快速、自动地初步识读,从而为亚述学家提供起点,加速古代文明的研究进程。

为了解决楔形文字识别中"视觉不可读"的问题,Zack 开发了以苏美尔书写女神 Nisaba 命名的 NisabaRelief 系统。以 Flux.2 Klein 作为基础,创新性地开发了在缺乏昂贵3D扫描设备的情况下,从普通照片中恢复泥板的表面几何结构的系统。该系统以单张泥板照片为输入,直接生成MSII(多尺度积分不变量)可视化结果,将原始图像中的光照、阴影、颜色与材质干扰全部剥离,仅保留与书写相关的几何浮雕信息,使楔形压痕清晰可辨,相当于用纯软件手段近似重建三维表面。NisabaRelief不仅实现了从二维照片到三维几何特征的跨维度恢复,更在效率上实现了质的飞跃。相比传统激光扫描及复杂的几何计算,系统将处理速度提升了约 600 倍,且在消费级硬件上即可运行。这意味着原本受限于高昂成本和长处理周期的 MSII 增强技术,首次具备了可以规模化应用在全球有照片记录的泥板上的能力。输出:去除光照/阴影/颜色干扰后的纯几何浮雕图像,清晰显示楔形压痕传统楔形文字数字化依赖多阶段流水线(图像预处理→分割→符号识别→语言模型校正),每个阶段的误差逐级累积,最终导致转录准确率出现不可控的下滑。

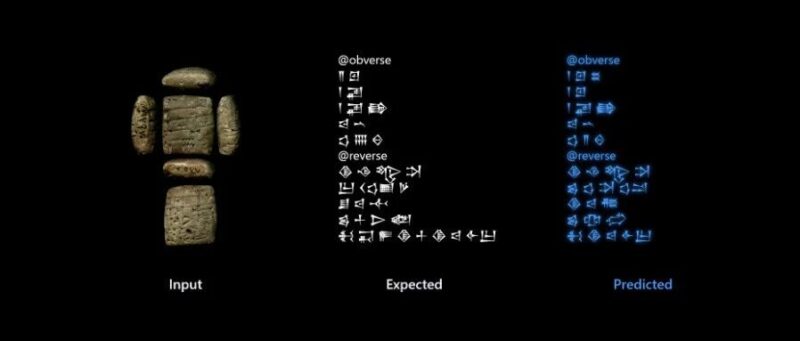

NabuOCR——以巴比伦书写之神 Nabu 命名——创新性地实现了从原始图像到学术标准转录文本的一步直达。Zack 基于 PaddleOCR-VL 进行深度改造与重新训练,从楔形文字数字图书馆(CDLI)的 135,000 条音译记录中清洗并筛选出 33,000 个高质量图像-转录配对,构建了一套端到端的处理流程,直接从图像中识别并转录楔形文字、输出学术标准的音译文本,大幅降低了系统复杂度和累积误差。在核心算法创新上,NabuOCR 解决了楔形文字场景下强化学习奖励信号稀疏的关键难题。由于楔形文字字符极度细微且结构重合度高,传统强化学习中的奖励函数难以对相似字符的细微差异给出有效的区分信号,导致策略优化缺乏梯度、模型难以收敛。Zack 创新性地引入了视觉相似度矩阵驱动的奖励函数,将离散的对错判定重构为基于视觉特征近缘程度的连续奖励,显著提升了强化学习在复杂字符语境下的优化精度与收敛速度,使原本因奖励稀疏而难以驱动的强化学习微调过程,转变为一个可有效优化、可泛化的连续学习过程。输入:泥板图像;输出:楔形文字的音译转录

下一代构想:OCR+翻译统一模型,解决“能不能读懂”

NisabaRelief 解决了"看清",NabuOCR 解决了"认字",但研究者的终极目标是"读懂"。目前的两阶段方案虽然已大幅提升效率,但音译与翻译仍是分离的,研究者需要额外步骤才能获得可读译文。为此,开发者计划采用文心 ERNIE-4.5-VL-28B-A3B 作为基座模型,利用其异构混合专家设计和模态隔离路由机制,将OCR和翻译融合为单一模型进行联合训练。模型接收照片与MSII双路输入,先输出音译、再生成翻译,实现对楔形文字更深层的领域理解。从一场开发者挑战赛中孵化,到逐步走向学术界的实际应用——Zack 的项目正是全球各地开发者社区利用文心飞桨技术生态创造价值的缩影。这个项目不仅帮助古文字识别者打破了对昂贵3D设备与顶尖专家的依赖,更是为全球研究者们提供了一套高效的“数字工具箱”。让那些沉睡在博物馆库房中、因风化而模糊的海量泥板残片转化为可检索、可分析的数字科研资源,缩短了我们与古老文明之间的距离。让每一块文明的碎片都能在数字世界中重获新生,让 AI 成为人类文明记忆的数字守护者。![图片[7]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/themes/zibll/img/thumbnail-lg.svg)

![图片[8]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/themes/zibll/img/thumbnail-lg.svg)

<原文链接:https://mp.weixin.qq.com/s/OkNI1JcgsLUlS-DP3ENh0w

![图片[1]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260401005546291-1774976146-bb4bcf6bfff7f6c6d74e79ad8c53c28d.gif)

![图片[2]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260401005550115-1774976150-b4c480955c1a90be3a0747cce50c53c6.png)

![图片[3]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260401005553222-1774976153-36df7443ce7e3712850efe38526b8184.png)

![图片[4]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260401005555908-1774976155-e4fcb336188bd745d46fba7a11e5d82c.png)

![图片[5]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/04/20260401005557197-1774976157-e747e20d35fb082b06e4195d1a7c750c.png)

![图片[7]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260328014808378-1774633688-1d6a1083ee5d63ee1dd35372c656428d.png)

![图片[8]-用多模态AI解读楔形文字:从泥板照片到可检索的数字文本-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/03/20260328014810217-1774633690-d5575f7554c5e19262e1a474ffff4e84.png)

暂无评论内容