![图片[1]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230427270-1770303867-d947bb1561d2546e1c8d81683048806b-767x1024.png)

![图片[2]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230439493-1770303879-d9ad675cae1c35ce9f0312e9863245b6-626x1024.png)

![图片[3]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230447223-1770303887-38c9a19b84dacfb3cc45f713e5f71202-1024x617.png)

![图片[4]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230446373-1770303886-baa91876c41f711feba0aaf999526f26-1024x787.png)

![图片[5]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230454265-1770303894-a34e3df5585a206e4710d5b641c1be91-1024x420.png)

![图片[6]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230458496-1770303898-79a9a4571a1e93982466d7ed075c59d0-1024x354.png)

![图片[7]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230516342-1770303916-a68e193cd9137c61e5c1ca0e8628b97b-1024x936.png)

![图片[8]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230520668-1770303920-56be363d9a0732801eff13d8b588263c-950x1024.png)

![图片[9]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230523140-1770303923-f26d46452b2b2cff62a2023c5a16e1ac-1024x976.png)

![图片[10]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230526173-1770303926-9703567fd2de2032ed308b790b330544-745x1024.png)

![图片[11]-谷歌PaperBanana来了:这“香蕉”太懂科研-AI Express News](https://www.aiexpress.news/wp-content/uploads/2026/02/20260205230546820-1770303946-c702c7755cb6f028ac654cf8f89dfbac-844x1024.png)

谷歌PaperBanana来了:这“香蕉”太懂科研

继 Nano Banana 之后,谷歌又发布了 PaperBanana,旨在把科研人员从耗时的论文插图绘制工作中解放出来。

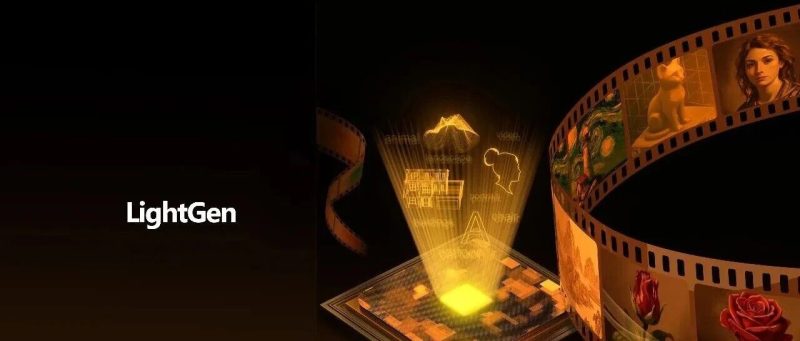

学术插图是信息承载的核心,也是传播过程的关键瓶颈:既要准确呈现方法细节,又要符合版式、标注与可编辑规范。因此,高质量学术插图的产出长期被视为研究中的劳动密集环节。Nano Banana 虽提升了图像质量与指令遵从,但单一生成模型仍难满足学术出版要求。

而 PaperBanana 完成了一条从单一的生成模型,到由 SOTA 视觉-语言模型(VLM)驱动的多智能体系统的发展与进化路径。基于 PaperBanana 的基准与大量实验展示了该框架在生成学术论文中的方法示意图和统计图方面的可行性与应用潜力。

1.核心突破:建立“生成-反馈-优化”的多智能体协作框架

PaperBanana 的核心突破在于建立了一个多智能体协作框架(图3),它更像专业的设计团队在将科学内容转化为具发表水平的插图。

1️⃣ 检索员:先去高质量论文库里“查资料”,检索出相似的视觉参考案例,生成符合的学术风格。

2️⃣ 规划师:是系统的认知核心。把复杂的文字拆解成点、线、面,并且规划好哪里放模型,哪里放数据。

3️⃣ 造型师:为了确保输出符合学术论文的审美标准,造型师的参考集合多个关键维度。

4️⃣ 可视化专家:收到造型师风格优化后的描述后,将学术图示生成出来并迭代提升质量。

5️⃣评论家:插图画好后,评论家会对比原始论文描述进行自发性迭代。如果发现错误,就打回去给可视化专家重画。

2.实验结果:关键指标提升,实现“学术美学”

为验证 PaperBanana 的能力,研究团队构建了包含 NeurIPS 2025 中 292 个真实案例的基准测试集。与 Nano-Banana-Pro 的对比中,PaperBanana 在简洁性、可读性、综合美学度多个关键指标上实现了提升(图6)。

虽然 PaperBanana 在方法论图上表现惊艳,但也存在局限:在处理密集节点的复杂架构时,扩散模型会出现文字扭曲或连线错误;对需要“像素级精确”的数据可视化,纯图像生成仍存在错误。

PaperBanana 表明,优化 Agent 的协作组织比单纯堆叠参数更具意义。未来的进化方向将引入代码扩散模型绘图,并开发人机协作接口,允许科研人员通过自然语言微调局部细节。

让科研人把时间更多花在构思新奇 idea 上,把繁琐复杂的绘图交给这根懂学术的“香蕉”吧!

暂无评论内容